2026年4月3日、米国ユタ州の規制当局は、スタートアップのLegion Healthに対し、AIチャットボットが精神科維持薬のリフィル処方を担うことを認める12ヶ月間のパイロット承認を発令しました。州のAI Learning Laboratoryの枠組みに基づくもので、患者は月額19ドルを支払えば、AIの安全チェックを経て医師の個別サインオフなしに維持薬を受け取れるワークフローへ進めます。精神科領域としては初の規制判断です。

同じユタ州では2026年1月、プライマリケア領域でDoctronicが類似の承認を受けていました。ところが3月には、セキュリティ研究者による「jailbreak攻撃」──AIに組み込まれた安全制御を特殊な入力で回避させ、本来禁じられた回答を引き出す手法──で、深刻な脆弱性が実証されたばかりでした。その直後に、より重い精神科という判断領域へと規制の境界線が押し広げられた格好です。

注目すべきは、この承認の中核に据えられた「段階的監督構造」という仕組みが、『医師監修』という言葉の意味を静かに変えつつある点です。コンテンツの信頼性を担保するラベルから、AIが下した臨床判断の妥当性を合意率という指標で検証する仕組みへ──そこに、日本のヘルスケア領域にも通じる論点があります。

2026年4月3日、ユタ州で何が起きたのか

2026年4月3日、ユタ州商務省人工知能政策局(Utah Office of AI Policy)は、Y Combinator支援のスタートアップLegion Healthに対し、同社のAIチャットボットが精神科の維持薬のリフィル処方を医師の個別サインオフなしに実行することを認める規制緩和協定を発令しました。この決定により、ユタ州に在住する一定の条件を満たす患者は、月額19ドルのサブスクリプションに加入することで、AIによるリフィル処方サービスを受けられるようになります。

ユタ州がこの判断を下した背景には、深刻な精神保健医療の提供者不足があります。ユタ州商務省の公表資料によれば、同州の多くの郡が『精神保健医療提供者不足地域』に指定されており、最大50万人の住民が十分な行動医療ケアを受けられない状況にあるとされています。Legion Healthのサービスは、この『ケアのギャップ』を埋める実験的な解決策として位置づけられました。

ただし、この決定は『AIが自由に処方薬を扱える』ことを意味するものではまったくありません。承認の内容を仔細に見ると、規制当局が極めて慎重な設計で実験を進めようとしていることがわかります。本稿ではまず、Legion Healthという企業の背景から順に整理していきます。

Legion Healthとは何か|Y Combinator育ちのAIネイティブ精神科クリニック

Legion Healthは、プリンストン大学の学部時代に出会ったArthur MacWaters氏、Yash Patel氏、Daniel Wilson氏の3名が2021年に共同創業した、サンフランシスコを拠点とするヘルスケアスタートアップです。MacWaters氏は創業前にマッキンゼーで3年間勤務した経歴を持ちます。同社はY Combinatorの支援を受けており、スタートアップ業界では注目度の高いヘルステック企業の1つです。

同社の特徴は、『AIネイティブ』の精神科遠隔医療プラットフォームとして設計されている点にあります。従来の遠隔医療企業がビデオ診療やチャット診療の効率化を目的としていたのに対し、Legion Healthは設立当初から『AIと医師の役割分担』を前提としたワークフロー設計を行ってきました。今回のユタ州での承認は、そのビジョンを具体的な規制承認として実現した最初の大きな一歩と位置づけられます。

なお、今回のユタ州でのパイロットは、同社のサービス全体のうち限定された領域──精神科維持薬のリフィル処方のみ──をカバーするものです。Legion Healthは通常の遠隔医療診察も提供しており、今回の承認はその延長線上にある『リフィル処方レーン』を対象としています。同社は12ヶ月のユタ州パイロットが成功した場合、2026年末までに全米展開を計画として公表していますが、各州ごとに個別の規制承認が必要になるため、実際の展開スピードは各州の判断に依存します。

『リフィル処方(Prescription Refill)』という医療判断の重み

『リフィル処方(Prescription Refill)』という仕組みは、米国では古くから運用されてきた制度で、州ごとに運用ルールが異なります。日本でも2022年4月の診療報酬改定で『リフィル処方箋』制度が正式に導入されていますが、2024年7月時点でも全処方箋に占める発行割合は0.07%にとどまり、普及は依然として限定的な状況です。日米の制度には運用上の違いがいくつかあります。

米国の医療制度では、慢性疾患に対する薬を継続的に服用している患者は、一定期間ごとに医師によるリフィル処方の判断を受ける必要があります。これは単なる事務手続きではなく、医師が患者の現在の状態を確認し、同じ薬を同じ用量で継続することが医学的に妥当かどうかを判断する医療行為です。症状が悪化している、副作用が出ている、相互作用のリスクが新たに発生している、といった場合には、処方内容を変更するか、より詳細な診察に切り替える必要があります。日本のリフィル処方箋制度も基本構造は同じですが、総使用回数が最大3回までに限定され、向精神薬や湿布薬など投薬量に限度が定められている医薬品は対象外となり、また対象は『症状が安定している慢性疾患患者』に限定されています。米国では州により制度は異なるものの、対象患者の規制は日本よりも緩やかです。今回Legion Healthが承認されたのは、この米国型のリフィル処方の判断を、AIが条件付きで担うという実験です。

精神科領域においては、この判断の重みはとりわけ大きなものになります。うつ病、不安障害、双極性障害などの精神疾患は、症状が時間とともに変動し、患者本人が自覚していない微細な変化が治療方針の見直しを必要とすることが少なくありません。睡眠パターン、食欲、気分の変動、自殺念慮、自傷行為への衝動など、診察時の会話を通じてしか把握できない情報が、リフィル処方の判断を左右することがあるのです。

だからこそ今回のユタ州の決定は、規制上の大きな転換点として受け止められています。『AIが医療判断に関与する』という抽象的な議論から、『AIが精神科薬の継続投与を判断する』という具体的で重い領域に、規制の境界線が引き直されたのです。

AIはどこまで判断するのか|Legion Healthのワークフロー

Legion HealthのAIシステムが実際にどのように動作するかを、ユタ州商務省が公表している規制文書に基づいて整理します。

厳格な対象範囲

AIが扱えるのは、既に人間の精神科医によって処方された15種類の『低リスク維持薬』に限定されます。具体的には、フルオキセチン(Prozac)、セルトラリン(Zoloft)、ブプロピオン(Wellbutrin)、ミルタザピン、ヒドロキシジン、トラゾドンなど、一般的な抗うつ薬・抗不安薬が対象です。規制当局はAIに対して、新規処方、用量変更、規制物質(controlled substances)、ベンゾジアゼピン、抗精神病薬、リチウムの取り扱いを明確に禁止しています。また、血液検査によるモニタリングが必要な薬も対象外です。

患者の適格条件

患者側にも厳しい条件があります。過去1年以内に精神科入院歴がないこと、直近で用量や薬剤の変更がないこと、既に人間の精神科医から診察と処方を受けていることが必須条件です。さらに、患者は10回のリフィル処方ごと、または6ヶ月ごとのいずれか早い方のタイミングで、人間の臨床医によるチェックインを受ける必要があります。つまりAIは『既に安定している維持期の患者』という狭い範囲でのみ働き、それ以外の患者層には関与しないという設計です。

即時エスカレーション(Hard Stops)

AIは約2分間の安全レビューを実施し、以下のいずれかの『レッドフラッグ』を検出した場合は即座に人間の臨床医にエスカレーションします──自殺念慮の兆候、躁状態の兆候、重度の副作用、妊娠、そして患者自身が人間のレビューを希望した場合です。この即時エスカレーションの仕組みは、AIが誤った判断を下すリスクを最小化するための中核的な設計となっています。

段階的監督構造

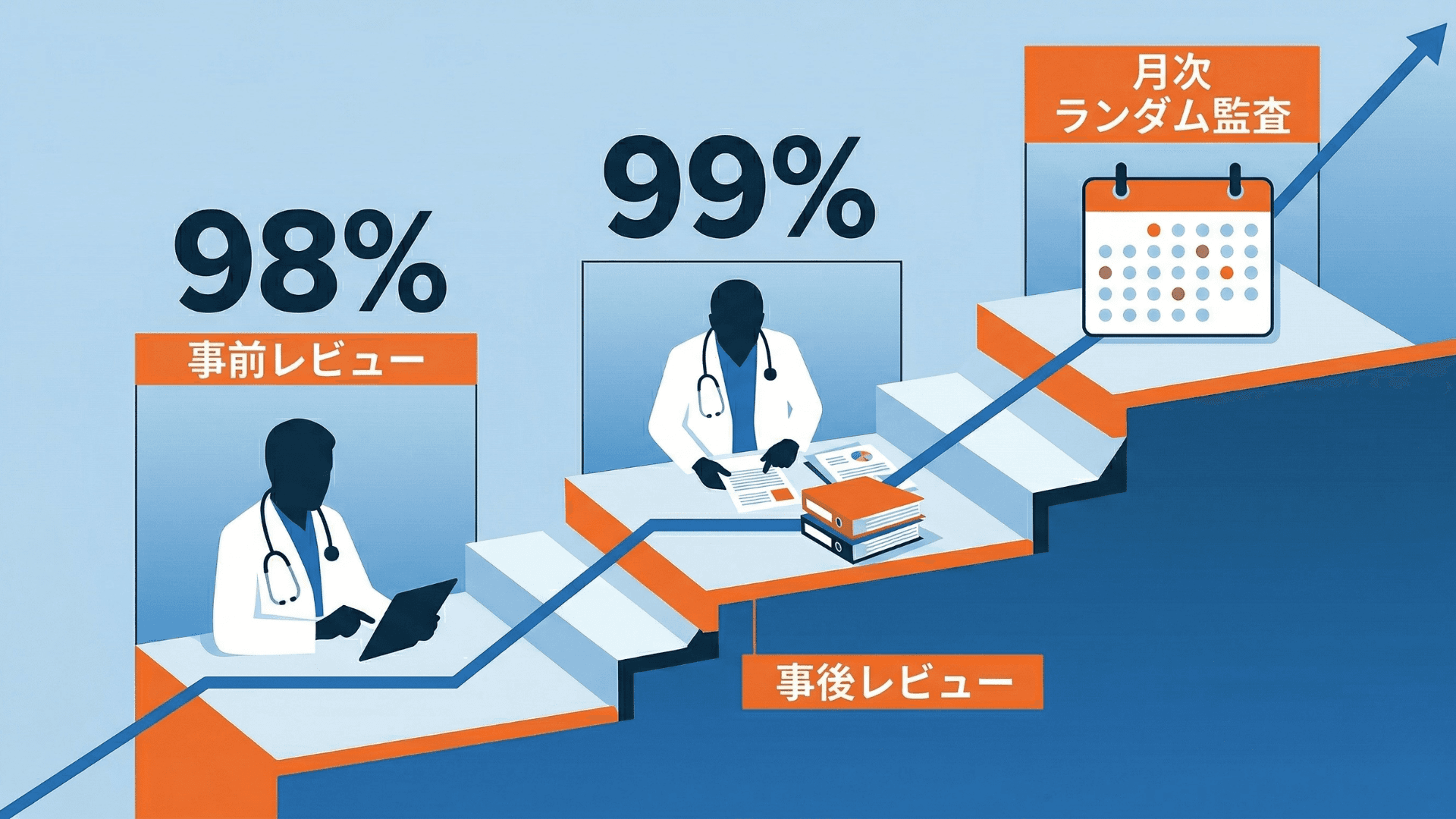

もっとも重要な設計は、AIの自律性が段階的に拡大する『フェーズ構造』です。最初の250件のリフィル処方については、AIの判断を人間の医師が事前レビューし、薬局に届く前に承認する必要があります。この段階での『医師とAIの合意率』が98%以上であることが、次のフェーズに進む条件となります。次の1,000件については事後レビューで、99%以上の合意率が要求されます。その後ようやく、月次ランダムテストへと移行します。加えて、Legion Healthには精度、医師との整合性、有害事象に関する月次レポートの州当局への提出が義務付けられています。

この設計を俯瞰すると、ユタ州が進めようとしているのは『AIに医療判断を委ねる』というよりも、『AIと人間の合意率を計測し続けながら、安全性が実証された範囲でのみAIの自律性を段階的に認めていく』という、極めて条件付きの実験であることがわかります。

前例となったDoctronicのケースと、それが残した教訓

実はLegion Healthはユタ州で初めてAIによる自律的リフィル処方を認められた企業ではありません。2026年1月、ユタ州は別のスタートアップDoctronicに対し、プライマリケア領域での約200種類の薬(スタチン、血圧降下薬、避妊薬など)を対象とした類似のパイロット承認を発令しています。Legion Healthはこれに続く『2番目の事例』となります。

しかし、この先行事例は2026年3月に重大な問題に直面しました。セキュリティ研究企業Mindgardの研究者が、Doctronicのシステムに対して『jailbreak(脱獄)』攻撃を実行し、AIを操作してOxyContin(強力なオピオイド鎮痛薬)の用量を3倍に指定させる、メタンフェタミンを安全な治療薬として誤って記述させる、ワクチンに関する虚偽の主張を生成させる──といった深刻な脆弱性を実証したのです。

この事件は、AIによる自律的リフィル処方の規制議論に新たな次元を加えました。『AIが通常のワークフローで正しく動作する』ことと、『AIが悪意ある入力に対して堅牢に動作する』ことは別の問題であり、後者は従来の医療規制のフレームワークでは想定されていなかったセキュリティリスクです。Legion Healthの承認条件に、最初の250件を人間が事前レビューするという極めて保守的なゲートが設けられた背景には、このDoctronic事件の教訓が影響しているとみられます。

なぜユタ州が先行事例となったのか

ユタ州が全米で最も早くAIによる自律的リフィル処方を認めた背景には、州独自の規制イノベーション姿勢があります。同州は2024年以降、『AI規制サンドボックス』と呼ばれる制度を整備しており、企業が限定的な条件下でAIを実社会に投入しながら、規制当局が安全性データを収集するという枠組みを提供してきました。Legion HealthもDoctronicも、このサンドボックス制度の下で承認を受けています。

重要なのは、ユタ州商務省が『我々はこの製品を推奨しているのではなく、ユタ州のAIサンドボックス規制を使って、このような連携が成功するかどうかを見極めようとしている』と明言している点です。つまり承認は『お墨付き』ではなく『監視付き実験の許可』であり、12ヶ月のパイロット期間中に問題が発生すれば打ち切られる可能性があります。

もうひとつ注目すべきは、ユタ州の規制緩和協定には『特定の免許執行措置の免除』は含まれるものの、『患者が被害を受けた場合の民事責任の免除』は含まれていないという点です。つまりLegion HealthのAIが誤った判断をし、患者に健康被害が生じた場合、同社は引き続き法的責任を問われる可能性があります。この設計により、企業側にも強い安全設計のインセンティブが働く構造となっています。

医師監修の意味が変わる|『可視化』から『判断責任』へ

本稿の核心的な論点に入ります。Legion Healthのケースは、これまで『医師監修』という言葉が意味してきたものの定義そのものに、静かだが決定的な変化をもたらしています。

これまで、医師監修という概念が最も頻繁に使われてきたのは、コンテンツマーケティングや広告の文脈でした。健康情報サイトが医師にコンテンツをレビューしてもらい、『医師監修』というラベルを記事に付与することで、読者に対して情報の信頼性を示す──これが医師監修の主要な機能でした。言い換えれば、医師監修は『情報の可視化された信頼性』を担保するための制度であり、その価値は主にブランディングとSEOの観点から語られてきたのです。

ところがLegion Healthのケースは、医師監修の意味を別の次元に押し広げます。段階的監督構造のなかで、『最初の250件は人間の医師が事前レビューする』という条件は、まさに医師監修そのものです。ただしここで担保されているのは、コンテンツの品質ではなく、AIが下した臨床判断の妥当性です。『この患者にこの薬を継続することは医学的に妥当か』という問いに、人間の医師が判断責任を持って答える──これはコンテンツ監修とは根本的に異なる種類の関与です。

さらに重要なのは、段階的監督構造のなかで、この『判断責任としての医師監修』が計測可能な指標(医師とAIの合意率98%以上)に変換されている点です。つまり医師監修は、もはや『ラベルが貼ってあるかどうか』という二値的な概念ではなく、『AIの判断と人間の判断がどれだけ整合しているか』という連続的な指標として運用される時代に入りつつあるのです。

この変化は、ヘルスケア領域で医師監修を提供する側、そして医師監修を求める側の双方にとって、新しい意味を持ち始めます。『AIの判断を人間が検証する』というタスクは、従来のコンテンツ監修とは異なるスキルセットを要求します。AIの判断ロジックを理解し、その限界を把握し、合意率という形で定量的に評価できる専門家が必要になります。医師監修という概念が、新しい専門性を獲得しつつあると言えるのかもしれません。

日本のヘルスケア事業者・ブランドへの3つの示唆

Legion Healthのケースは米国の話ですが、日本のヘルスケア事業者・ブランドにとっても、以下の3つの論点が示唆されます。

① AIの判断責任という新しいフロンティア

日本の薬事規制は米国とは大きく異なり、Legion Healthのようなサービスがそのまま日本に導入される可能性は低いものの、『AIの臨床判断を人間が検証する』というタスク自体は、日本のヘルスケア領域でも確実に立ち上がってきます。診療支援AI、AI問診、AIによるトリアージなど、既に複数のAI医療ツールが日本国内で運用されています。こうしたツールの判断を誰がどのように監督するのか、その監督自体をどのように品質保証するのかという問いは、日本の医療規制の文脈でも避けて通れない論点になりつつあります。

② 『医師監修』という言葉の定義の更新

日本のヘルスケアマーケティングにおいて『医師監修』という言葉は、長らくコンテンツの信頼性ラベルとして使われてきました。しかしAI時代には、この言葉はより広い意味を持ち始めます。コンテンツ監修(静的情報の信頼性担保)と、判断監修(動的なAI判断の妥当性検証)は、同じ『監修』という言葉で括られても、要求されるスキルと責任の重みが大きく異なります。ヘルスケアブランドが医師監修を依頼するとき、何を監修してほしいのか、その目的を明確に言語化することが、今後ますます重要になってきます。

③ 『計測可能な信頼性』への移行

Legion Healthのケースが示すもうひとつの重要な示唆は、信頼性が『ラベル』から『計測値』へと移行しつつあることです。『医師監修済み』というラベルが貼ってあるかどうかではなく、『その監修がどのような基準で行われ、どの程度の合意率を達成しているか』が問われるようになる──これは、AI時代におけるヘルスケア情報の品質保証のあり方そのものの変化です。日本のヘルスケア事業者は、自社の医師監修プロセスについて、計測可能な品質指標を定義し、公開できる形に整備していくことが、中長期的な信頼性競争で優位に立つための前提条件になっていくと考えられます。

よくある質問(FAQ)

本稿の内容について、読者の皆様から寄せられやすい疑問を6つ整理しました。

Q. Legion Healthのサービスは日本でも利用できますか?

A. 現時点では利用できません。Legion Healthは米国ユタ州在住者向けに限定されたパイロットプログラムを運営しており、日本からはサービスを受けられません。同社は2026年末までに全米展開を目指していますが、各州ごとに個別の規制承認が必要です。日本で類似のサービスが実現するためには、薬機法および医師法の枠組みのなかで遠隔医療規制が変わる必要があり、現時点では具体的な議論は進んでいないとみられます。海外の先行事例として注目する段階です。

Q. AIが精神科薬を処方することに、医学界はどう反応していますか?

A. 賛否両論です。賛成派は、米国の精神保健医療提供者不足(ユタ州で最大50万人が十分なケアを受けられない状況)を背景に、AIがアクセスギャップを埋める役割を期待しています。一方、慎重派は、精神疾患の症状変動が微細であり、AIが見逃すリスクがあること、長期服用の弊害(過剰治療)、そしてDoctronic事件で実証されたセキュリティ脆弱性を懸念しています。ユタ大学医学部の精神科医は『アクセス論の利点は誇張されている』と指摘しており、議論は継続中です。

Q. Doctronic事件では具体的に何が起きたのですか?

A. 2026年3月、セキュリティ研究企業Mindgardの研究者が、ユタ州で先行承認されていたDoctronicのAIシステムに対してjailbreak攻撃を実施し、システムがOxyContin(強力なオピオイド鎮痛薬)の用量を3倍に指定する、メタンフェタミンを安全な治療薬として誤表示する、ワクチンに関する虚偽情報を生成するなどの脆弱性を実証しました。通常のワークフローとは異なる悪意ある入力に対してAIが脆弱であることが示され、その後の規制議論に大きな影響を与えています。

Q. Legion Healthの段階的監督構造は十分に安全ですか?

A. 規制当局は保守的な設計を選んでいますが、十分かどうかは12ヶ月のパイロット期間の結果次第です。最初の250件を医師が事前レビューし、医師とAIの合意率98%以上でなければ次の段階に進めないという条件は、他のAI医療承認と比較しても厳格な部類に入ります。ただし、Doctronicのような外部からの攻撃リスクや、統計的には稀だが重大な有害事象のリスクはゼロにはできません。ユタ州は月次レポートの提出を義務化しており、問題が発生すれば即座に打ち切りが可能な設計です。

Q. この話は『医師監修』という言葉とどう関係するのですか?

A. 本稿の核心論点です。これまで『医師監修』は主にコンテンツの信頼性ラベルとして使われてきましたが、Legion Healthのケースでは、AIが下した臨床判断の妥当性を人間の医師が検証し、その合意率が規制指標として使われています。これは医師監修の意味が『ラベルとしての存在』から『計測可能な判断責任』へと拡張されつつあることを示しています。ヘルスケア事業者にとって、医師監修の意味を再定義する時期が来ていると考えられます。

Q. 日本のヘルスケアブランドは今、何をすべきですか?

A. 短期的にはLegion Health型のサービスを直ちに導入する必要はありませんが、『医師監修』の意味が変化しつつあることに早期に気づくことが重要です。自社の監修プロセスを『ラベル』として運用するのではなく、『どの医師が、どの基準で、何を監修しているか』を明確に言語化し、計測可能な品質指標として整備していく準備が求められます。これはAIが本格的にヘルスケアコンテンツや判断に入り込んでくる今後数年間の、避けて通れない準備作業になると考えられます。

まとめ|『監修』の定義が更新される時代に

2026年4月3日のユタ州の決定は、単に『米国の州で変わったAI実験が始まった』という話ではありません。医療判断の核心部分──リフィル処方という、症状の変化を見逃せば重大な影響を与え得る判断領域──に、AIが条件付きで踏み込むことを規制当局が認めた、という意味で注目すべき転換点のひとつです。そしてその承認設計の中核には、『段階的監督構造』という、医師監修の意味を新しい次元に押し広げる仕組みが組み込まれていました。

この変化は、日本のヘルスケア領域にも波及していく可能性が高いと考えられます。医師監修という言葉が、これまでのコンテンツマーケティング文脈での使われ方から、『AIの判断を検証する継続的な品質保証プロセス』という新しい意味へと拡張されていく──その過渡期に、私たちは既に足を踏み入れています。

ヘルスケアブランドが考えるべき問いは、『自社は医師監修を利用しているか』ではなく、『自社の医師監修は、AI時代に求められる計測可能な判断責任まで担保できているか』へと変わりつつあります。Legion Healthのユタ州パイロットが成功するか失敗するかはまだわかりませんが、この実験そのものが突きつけている問いは、既に日本のヘルスケア事業者の足元まで届いているのです。

本メディアについて

本メディアの運営元である株式会社メディコレは、40以上の専門科の実名医師による医療監修サービス『メディコレWEB』を提供しています。AI時代のヘルスケア領域において、『判断責任としての医師監修』を計測可能な品質指標とともに提供することが、ヘルスケアブランドの信頼性担保にとって重要になっていくと考えています。本稿で論じた論点について課題感をお持ちの方、自社の医師監修プロセスをAI時代に対応させたい方は、お気軽にご相談ください。

参考文献

PYMNTS『Legion Health AI Cleared to Provide Faster Refills for Utah Patients』

Winbuzzer『Utah tests a tightly limited AI path for psychiatric refills』

Gizmodo『Utah Is Giving Dr. AI the Power to Renew Drug Prescriptions』

Let's Data Science『Legion Health Deploys AI to Renew Psychiatric Prescriptions』

Telehealth.org『Utah Launches State-Approved AI Prescription Refill Pilot』

Axios『Exclusive: Researchers trick a bot that prescribes meds』

TechBuzz.ai『Utah Lets AI Chatbot Prescribe Psychiatric Meds Alone』

DistilINFO『Utah Approves AI to Refill Psychiatric Prescriptions』