「Google AI Overviewsの一部応答に、医療現場の標準的な指導と異なる内容が含まれていた」——2026年1月、英国のThe Guardianが公開した調査報道は、世界中の医療関係者に注目されました。報道後、Googleは問題のあった応答の一部を削除する措置を取り、欧州呼吸器学会(ERS)をはじめとする複数の医学団体が公式に懸念を表明する事態となりました。

本コラムでは、The Guardianの調査が具体的にどんな応答事例を指摘したのか、Googleはどう対応したのか、そしてこの一連の出来事がヘルスケアコンテンツマーケティングに何を意味するのかを整理します。Guardian調査が浮き彫りにしたAI検索の医療応答に関する課題は、企業の医療コンテンツ戦略にとって重要な示唆が含まれていました。

何が起きたのか:Guardian調査が指摘した応答事例

The Guardianが2026年1月2日に公開した調査報道で指摘されたGoogle AI Overviewsの応答事例は、「単なる不正確な情報」というレベルを超えていました。Guardianは複数の健康関連検索クエリでAI Overviewsの応答を取得し、患者団体・医療チャリティ団体・医療専門家にレビューを依頼しました。報道によれば、健康関連検索クエリの一部に対するAI Overviewsの応答には、患者の予後に直結しかねない深刻な誤りが含まれていました。

膵臓がん患者への食事指導における不正確な応答事例

第一の事例は、膵臓がん患者への食事指導に関する不正確な応答です。AI Overviewsは膵臓がん患者に対して「高脂肪食を避けるように」と助言していましたが、これは医療現場の標準的な指導と異なる内容です。膵臓がん治療では、化学療法や手術に耐えるための体重維持・栄養確保が最重要課題であり、十分なカロリー摂取が推奨されます。

Pancreatic Cancer UKのDirector of Support, Research and Influencingを務めるAnna Jewell氏は、AIの助言に従った患者が必要なカロリーを摂取できず、化学療法や生命を救う手術に耐えられなくなる可能性を強い言葉で警告しました。

「Google AI Overviewsの応答は、膵臓がん患者に高脂肪食を避けるよう示唆し、具体例まで挙げています。しかし、この検索結果に従った人は、十分なカロリーを摂取できず、体重を増やせず、化学療法や生命を救う手術にすら耐えられなくなる可能性があります」(Anna Jewell, Pancreatic Cancer UK)

肝機能検査の参照範囲に関する応答事例

第二の事例は、肝機能検査(LFT)の参照範囲に関する応答です。AI Overviewsは肝機能検査の数値解釈について、年齢・性別・民族・国籍といった患者特性を考慮しない一律の参照範囲を提示していました。肝機能検査の正常値は、これらの要因によって有意に変動することが医学的に確立されており、画一的な数値の提示は重大な肝疾患を見逃す原因となりかねません。

British Liver TrustのChief ExecutiveであるPamela Healy OBE氏は、深刻な肝疾患を持つ患者が「自分の検査結果は正常範囲内だ」と誤解し、フォローアップの受診を怠る危険性に警鐘を鳴らしました。なお、この事例についてはGoogleが報道後に該当する応答を削除したことが、後続報道で確認されています。

子宮頸がん検査(pap test)の関連付けに関する応答事例

第三の事例は、女性のがん検査に関する応答でした。AI Overviewsは、ユーザーが「膣がん(vaginal cancer)」の症状や検査について検索した際の応答で、子宮頸がん検査(pap test、cervical smear test)を膣がん検査として関連付けて提示していました。pap testは子宮頸がん(cervical cancer)を検出するための検査であり、膣がん(vaginal cancer)を検出する検査ではありません。

婦人科がん啓発団体The Eve Appealの最高経営責任者Athena Lamnisos氏は、この応答が患者の症状受診を遅らせる可能性を指摘しました。直近で子宮頸がん検診を受けた患者が「検査結果は正常だった」と判断して膣がんの症状を放置する危険性があるためです。同氏はさらに、同じクエリでも検索のたびに異なる情報源から異なる回答が生成されるという問題点も指摘しました。

医療チャリティ団体による懸念表明

Guardianの取材に応じて懸念を表明したのは、上記3団体に加え、メンタルヘルス支援団体Mind、終末期ケア団体Marie Curie、心血管疾患団体British Heart Foundation、医療情報業界団体Patient Information Forumなど多岐にわたります。Mindは、精神病(psychosis)や摂食障害といった敏感な話題でAI Overviewsが「非常に危険な助言」を行った事例を指摘しています。

Patient Information Forumのディレクターを務めるSophie Randall氏は、Guardianの取材に対して「Google AI Overviewsは不正確な健康情報をオンライン検索の最上部に表示することができ、人々の健康に対するリスクを生じさせている」と指摘しました。検索結果の最上部という最も視認性の高い位置に不正確な健康情報が表示されうることの構造的な懸念を、業界団体として正式に問題提起した形です。

Guardian報道後、欧州呼吸器学会(European Respiratory Society)は2026年1月、公式声明として「AIモデルが不正確で潜在的に有害な健康情報を生成している」との警告を発しました。BMJ Journal of Medical Ethicsのブログ(2025年11月)でも、AIモデルが最大48%の割合でハルシネーション(誤情報生成)を起こし、検索エンジンからの医療サイトへのクリックを40〜60%減少させているとの指摘がなされています。

Googleの対応:削除と継続運用の併存

The Guardianの調査報道を受けて、Googleは問題のあるAI Overviewsの応答の一部を削除する措置を取りました。とくに肝機能検査に関する応答については、調査報道後に削除が確認されています。

ただし重要なのは、Googleは健康関連クエリ全体からAI Overviewsを撤退させたわけではないという点です。Googleの公式コメントは「AI Overviewsの大半は事実に基づいており、有用である」というものでした。問題が確認された個別のクエリと応答について限定的な対応を行い、機能そのものは継続運用するという立場です。

この対応に対して、医療専門家からは「同じ検索の微妙なバリエーションでも、誤解を招くサマリーが表示される可能性が残る」という懸念が表明されました。AIによる情報生成の本質的な問題——同じ質問でも異なる応答が生成されうるという特性——は、個別のクエリ修正では根本解決しないというのが医療現場の共通認識です。Eve Appealの代表もインタビューで「検索するたびにAI Overviewsの内容が変わるのは問題だ」と指摘しました。

AI引用ソース選別の構造的特性

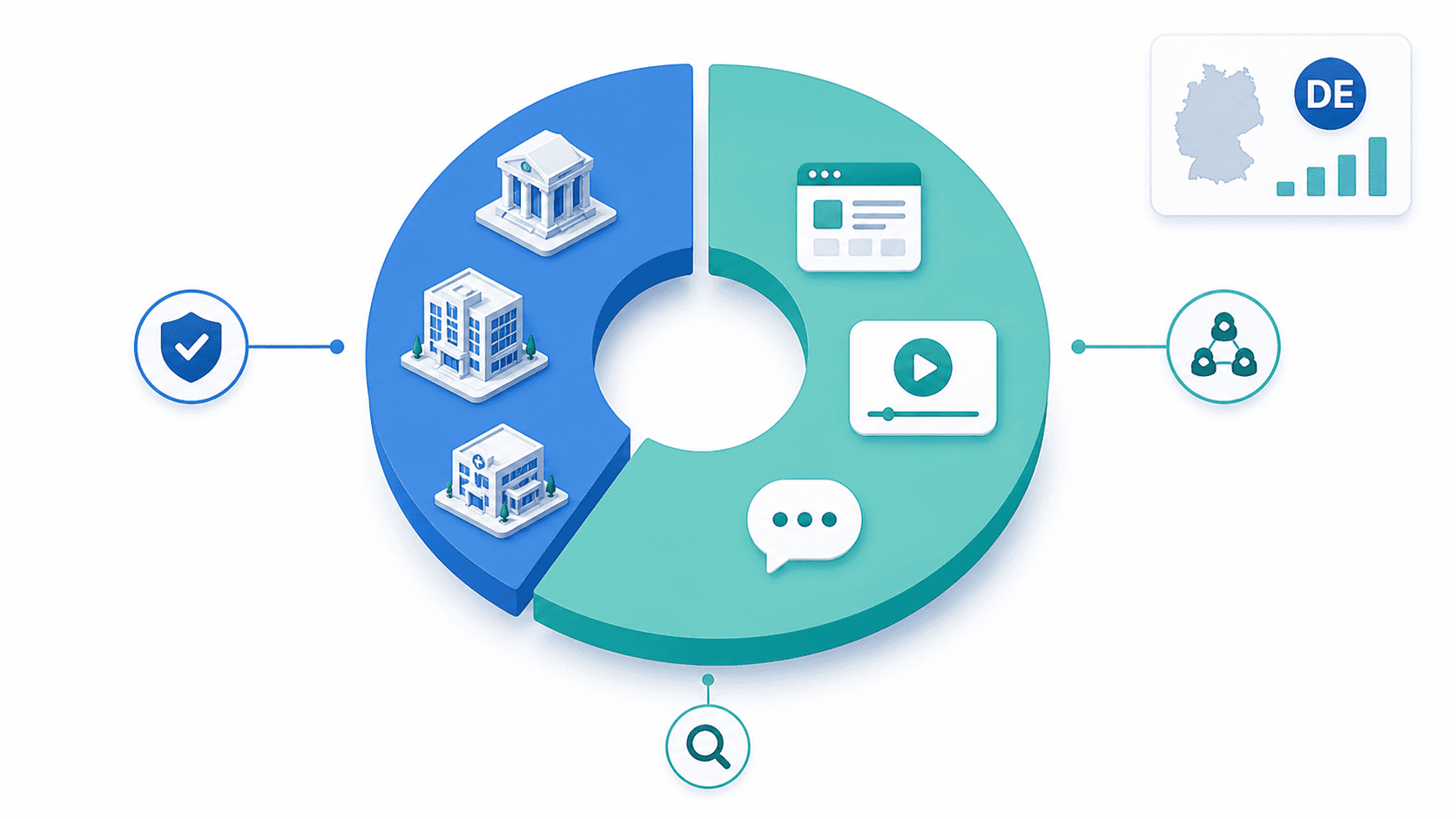

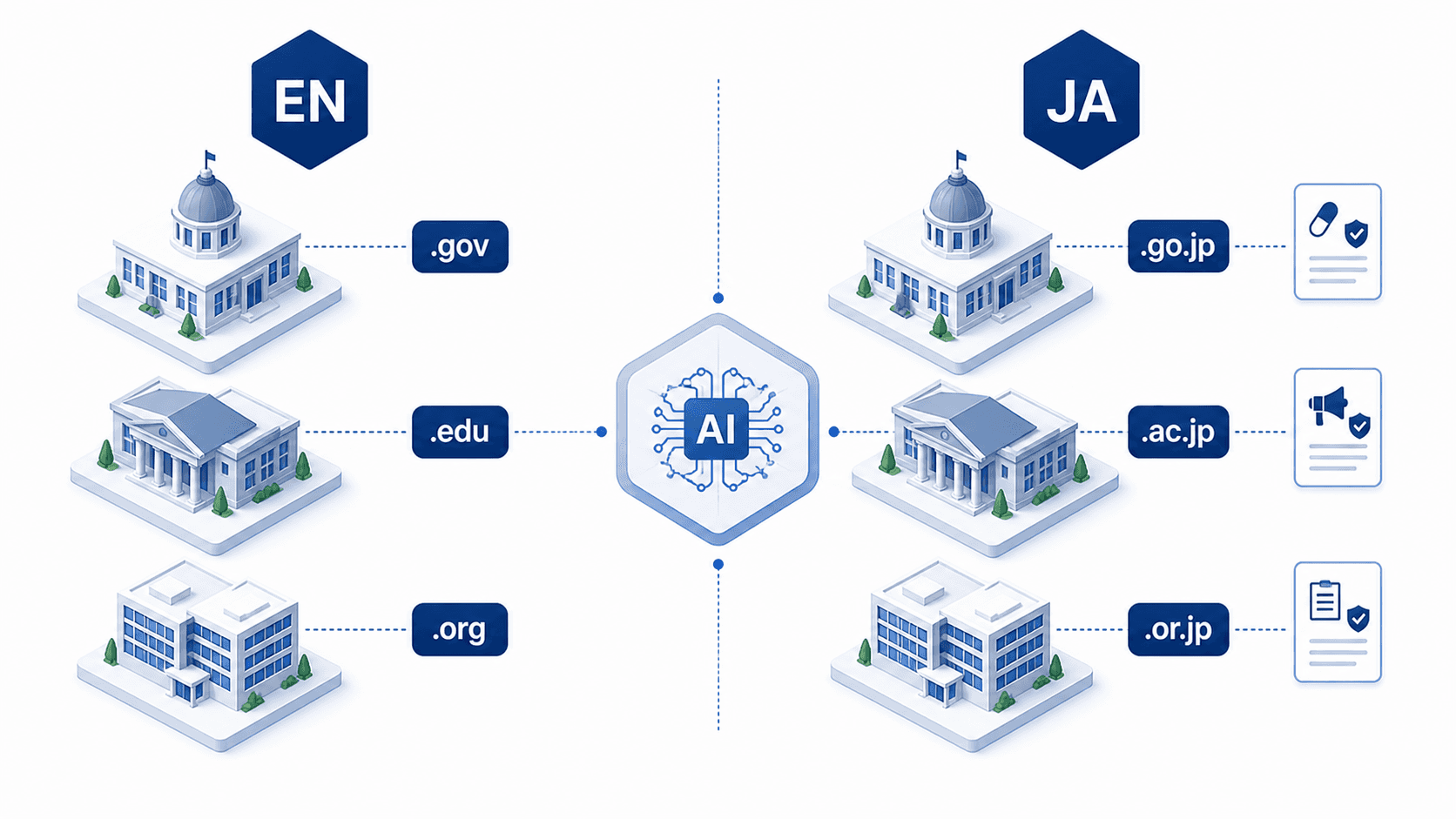

Guardianが指摘した個別の事例の背景には、AI Overviewsの引用ソース選別における構造的な特性も指摘されています。マーケティングプラットフォームSE Ranking社が2026年1月に公表した調査(50,000以上の健康関連クエリから抽出された465,823件の引用ソースをドイツ語のAI Overviewsで分析)によれば、AI Overviewsが引用したソースのうち、SE Ranking社が「より信頼できる医療情報源」(病院・クリニック・医療学会・公的医療機関など)に分類したのは34.45%にとどまり、残り65.55%は医学的正確性やエビデンスベースの基準に従って設計されていないソースから引用されていたと報告されています。なお、これは引用ソースの分類比率であって、引用された情報の正確性を直接測定したものではない点には留意が必要です。

さらに同調査で注目を集めたのが、YouTubeが医療機関や政府サイトより頻繁に引用されているという事実です。YouTubeは全引用の4.43%を占め、引用元として最多でした。これは、消費者向け健康ポータル(ドイツ最大手のnetdoktor.de)の3.5倍、医療リファレンスとして長年定評のあるMSD Manualsの2倍以上の頻度です。

本データはドイツ語のAI Overviews応答を対象とした調査であり、英語圏や日本語圏で同じ傾向がそのまま当てはまるかは別途検証が必要です。ただし、AIエンジンが引用ソースを選別する基本ロジックは言語非依存と考えられ、「YouTubeを医療情報源として優先する」という構造的な傾向は、他言語環境にも一定程度共通する可能性が高いと推測されます。学術論文や政府機関の医療ページが約1%しか引用されない一方、汎用動画プラットフォームが筆頭引用源になるという状況は、医療情報の信頼性インフラとして看過できない構造的課題です。

なぜ医療応答に不正確さが生じうるのか:AIの構造的特性

Guardianが指摘した個別事例の背景には、生成AI全般の構造的特性が関係していると考えられます。Stanford大学を中心とする研究チームが2025年にNature Communicationsに発表したSourceCheckup研究(Wu et al., 2025、800の健康関連質問・約58,000のステートメント-ソースペアを分析)では、LLM応答の50〜90%が引用ソースによって完全には支持されておらず、Web検索付きのGPT-4oでさえ約30%の文が引用元によって裏付けられていないことが報告されました。AIは「もっともらしい応答」を生成する能力には長けていても、「医学的に正しい応答」を構造的に保証する仕組みを現時点では持っていない、というのが研究知見の大筋です。

医療情報には特有の難しさがあります。同じ「肝機能検査の正常値」という質問でも、患者の年齢・性別・民族・国籍・既往症によって正解は変わります。「膵臓がんの食事」も、ステージや治療段階によって推奨が異なります。医学的な「正しさ」は文脈依存的であり、画一的なAI応答とは原理的に相性が悪いのです。

加えて、AIの応答には「自信過剰」という特性もあります。米英加の共同研究チーム(Lundquist Institute for Biomedical Innovation at Harbor-UCLA Medical Centerほか)が2026年4月にBMJ Openに発表した研究では、ChatGPT・Gemini・Meta AI・Grok・DeepSeekの5つの主要AIチャットボットに250問の健康質問を投げた結果、約49.6%が「問題のある」応答(うち19.6%は「重大に問題のある」応答)で、回答を拒否したのはわずか0.8%(2件)にとどまったことが報告されています。AIは「わからない」と答えるのが苦手で、不確実な情報でも自信ありげに提示してしまう傾向があります。

企業の医療コンテンツに何が求められるのか

Guardian調査が指摘した個別事例と、SourceCheckup研究やSE Ranking分析が示すAI応答の構造的特性。これらが併存する状況は、ヘルスケア領域で事業を展開する企業にとって、3つの戦略的示唆を含んでいます。

示唆①: AIによる情報伝達には「最終確認の主体」が不可欠

AIの応答は便利な一次情報ですが、最終判断には人間の医療専門家による検証が必要——この認識は、英国のPancreatic Cancer UK、British Liver Trust、The Eve Appeal、Mind、Marie Curie、British Heart Foundationといった医療チャリティ団体・患者団体の公式コメントを通じて、社会全体で共有される段階に入りました。企業の医療コンテンツも、この社会的合意に沿ったポジショニングを取る必要があります。

示唆②: AIに引用されるソースとしての医療コンテンツの価値再評価

AIが信頼できる引用ソースを必要としている一方で、現状はYouTubeが医療機関より頻繁に引用されるという歪んだ状態です(SE Ranking 2026年1月、ドイツ語AI Overviews調査)。実名の医師監修・出典の明示・最終監修日の記録を備えた企業のヘルスケアコンテンツは、AIにとっても価値の高い引用候補になりえます。コンテンツ品質を上げることが、AI時代のオウンドメディア戦略の中核になります。

示唆③: ブランド評判リスクとしてのAI応答への対応

膵臓がんや肝機能検査のような疾患・検査名で、自社製品やサービスがAI上で意図しない文脈に紐づけられていないか。サプリメントやOTC医薬品が、AI Overviewsで不適切な効能効果と関連付けられていないか。これらは従来のSEO監視の範囲を超えた、新しいブランド評判管理の課題です。AIプラットフォーム上での自社ブランドの引用状況を継続的にモニタリングし、誤った文脈での引用が確認された場合には、正確な一次情報を発信する形で軌道修正していく運用が求められます。

日本市場への示唆

今回のThe Guardian調査は英国で行われ、SE Rankingの構造分析はドイツ語環境のものです。ただし、AIエンジンの引用選別ロジックは言語非依存と考えられるため、日本語環境でも同様のリスクは存在すると考えるのが自然です。日本では薬機法・景品表示法・医師法という厳格な広告規制があり、医療コンテンツに対する規制環境はもともと厳しい状況にあります。

そのうえで、AI Overviewsは日本語の健康関連検索でも稼働しており、日本のユーザーも類似のリスクにさらされる可能性があります。さらに日本特有の問題として、機能性表示食品やサプリメントといった「医薬品ではないが健康効果を訴求する商品」のカテゴリが大きく、AIが薬機法上の境界を越えた表現を生成してしまうリスクが高い構造があります。

日本のヘルスケア企業は、自社のオウンドメディアやコーポレートサイトを「AIが信頼できる情報源として参照する」状態に整備することで、業界全体の情報品質向上にも貢献できる立場にあります。規制対応のための受け身の医師監修から、AI時代の情報インフラを担う能動的な医師監修へ——この発想転換が、いま求められています。

よくある質問(FAQ)

Q. Google AI Overviewsは日本語の検索でも医療応答に不正確な内容が含まれる可能性がありますか?

A. はい、可能性があります。AI Overviewsは英語圏で先行展開されたあと、日本を含む多言語で順次展開されており、生成AIの構造的特性は言語を問わず共通です。SourceCheckup研究(Wu et al., Nature Communications, 2025)で観察された「LLM応答の50〜90%が引用ソースによって完全には支持されない」という傾向は、日本語環境でも同様に当てはまる可能性が高いと推測されます。自社ブランドや商品カテゴリに関連するキーワードで、AI Overviewsが何を表示しているかを定期的に確認することをおすすめします。

Q. 自社の商品が誤った文脈でAI Overviewsに表示されていた場合、どう対応すべきですか?

A. まず、誤情報の具体的な内容と表示状況をスクリーンショット等で記録します。Googleには検索結果に対するフィードバック機能があり、不正確な情報を報告できます。並行して、自社のオウンドメディアやコーポレートサイトに、当該テーマについての正確な情報を医師監修付きで掲載することが、中長期的な対策となります。AIは時間をかけて引用ソースを学習し直すため、信頼できる一次情報の発信者として認識される状態を作ることが重要です。

Q. AI Overviewsに引用される医療コンテンツを作るためには、何から始めるべきですか?

A. 最低限の出発点は3点です。第一に、医師監修者の実名・所属・専門領域を記事内に明示すること。第二に、医学的事実には公的機関や査読済み論文の出典をリンクで添えること。第三に、最終監修日と最終更新日を別個に明記することです。これら3点が整うだけで、匿名・出典なし・更新日不明のコンテンツと比較してAI引用の獲得確率は変わると考えられます。本コラムの姉妹記事『AIに引用される医療コンテンツの条件』では、より詳細なチェックリスト10項目を整理しています。

Q. ChatGPTやPerplexityでも、医療応答に類似のリスクはあるのでしょうか?

A. はい、同様のリスクは存在します。BMJ Openに2026年4月14日に掲載された米英加共同研究では、ChatGPT・Gemini・Meta AI・Grok・DeepSeekの主要5モデルが健康関連質問の約半数で「問題のある」応答を生成したと報告されています。プラットフォームによって誤情報の発生パターンに差異もあるため、ブランド単位での横断モニタリングが現実的な対策です。Google AI Overviews、ChatGPT、Perplexity、Geminiといった主要プラットフォームに対して、自社ブランド名や主力商品名でクエリを投げ、応答内容を定期的に確認する運用が、AI時代のブランド評判管理の標準になりつつあります。

Q. メディコレに依頼すると、AI応答に伴うブランド評判リスクへの対策として具体的に何ができますか?

A. メディコレでは、40以上の専門領域にわたる実名公開の専門医ネットワークによる監修体制を提供しています。自社コンテンツを「AIが信頼できる引用ソース」として整備するための監修プロセスを実装できます。また、自社サービスのMedi-ARMでは、ChatGPT・Perplexity・Geminiといった主要AIプラットフォーム上での自社ブランドの引用状況・センチメント・誤情報の有無を継続的にモニタリングし、改善提案を行うことが可能です。

Q. AI応答の不正確さは、いずれ技術の進歩で解決するのではないですか?

A. 一定の改善は期待できますが、医療情報の文脈依存性という本質的な課題は、技術進歩だけでは解決しないと考えるのが現実的です。患者の年齢・性別・既往症・治療段階によって医学的に正しい答えが変わるという特性は、画一的な応答を生成するAIとは原理的に相性が悪い領域です。AIは医療情報の一次入口として今後も重要性を増しますが、最終判断は人間の医療専門家に依拠するという二層構造は、当面続くと考えられます。

Q. SE Rankingの調査はドイツ語AI Overviewsを対象としていますが、英語や日本語でも同じ傾向ですか?

A. SE Rankingが2026年1月に公表した分析(465,823件の引用を対象)はドイツ語環境のデータであり、英語圏や日本語圏で同じ数値がそのまま当てはまるかは別途検証が必要です。ただし、AIエンジンが引用ソースを選別する基本ロジックは言語非依存と考えられるため、「学術論文や公的機関より、汎用プラットフォームが優先される傾向」自体は他言語でも一定程度観察される可能性が高いと推測されます。本記事執筆時点で、日本語AI Overviewsの引用ソース構造を体系的に分析した公開データは限定的であり、このギャップを埋めることが、日本のヘルスケア企業のオウンドメディア戦略にとっての機会領域でもあります。

まとめ:AI時代のヘルスケアコンテンツ戦略の転換点

The Guardianの調査が指摘したGoogle AI Overviewsの医療応答に関する事例は、AI検索時代の医療コンテンツに対する社会的合意を形作る重要な事例となりました。膵臓がん患者への食事指導における不正確な助言、肝機能検査の参照範囲に関する不正確な提示、女性のがん検査に関する誤った関連付け——いずれも、患者の予後や行動に直接影響しうる深刻な事案として、医療チャリティ団体・患者団体が公式に懸念を表明する結果となりました。

この出来事から導かれる結論は明快です。AIによる医療情報の量産と、人間の医療専門家による検証は、対立するものではなく補完するものである、ということです。AIは便利な一次情報の入口として今後も発展しますが、その情報の信頼性を担保するのは、依然として実名の医療専門家による監修プロセスです。

ヘルスケア領域で事業を展開する企業にとって、いま重要なのは、自社のオウンドメディアやコーポレートサイトを「AIが安心して引用できる情報源」へと整備することです。それは消費者の安全に貢献すると同時に、AI時代における自社ブランドの可視性と信頼性を確保する、最も合理的な投資となります。

メディコレWEBによる医師監修

オンライン完結で医師監修ができるメディコレWEBについては以下の記事をご確認ださい。

▶︎「オンライン完結!メディコレの医師監修サービス「メディコレWEB」とは?」

また、メディコレWEBの医師監修で実際に何がチェックされるのか、専門医が出した7件の修正指示を実例公開した記事もあわせてご覧ください。

▶︎メディコレWEBの医師監修プロセスを実例公開|専門医が22分間で出した7件の修正指示

ご興味いただけましたら、いつでもお気軽にお問い合わせください。