「自社の健康コンテンツが、ChatGPTやPerplexityで引用されない」——マーケティング担当者からこんな相談を受ける機会が、2026年に入って急増しています。検索流入の競争はすでに次のフェーズに移っており、評価基準は「Google検索で上位に出るか」から「生成AIに引用されるか」へと拡張されました。

本記事では、海外の最新研究データをもとに、AIに引用される医療コンテンツが満たすべき条件を、技術要件・コンテンツ要件・運用要件の3層に分けて整理します。BtoBマーケティング部門の実務担当者が、明日から自社サイトの改修に着手できる粒度まで具体化した実装ガイドです。

AIが医療コンテンツを引用する仕組みとは

まず押さえておきたいのは、AIによる引用ソース選別が決して無作為ではないという事実です。2026年1月にmedRxivで公開された米国の研究「Authority Signals in AI Cited Health Sources」(Jacques et al., 2026, ニューヨーク市立大学・コロンビア大学ティーチャーズカレッジほかの共同研究、査読前プレプリント)では、Google Researchが整備した消費者向け健康質問データセットHealthSearchQAから無作為に選んだ100の質問をChatGPT 5.2 Proに入力し、回答に含まれた合計615件の引用ソースを分析しました。

結果として、引用元の75%以上がMayo Clinic、Cleveland Clinic、Wikipedia、NHS、PubMedといった機関的に確立されたソースから来ていたと報告されています。AIは健康情報を扱う際、明確な「権威性のシグナル」を選別しているといえます。

AIが評価する3つの権威性シグナル

ChatGPTやPerplexityといった主要な生成AIが、医療コンテンツを引用ソースとして採用する際に評価しているシグナルは、大きく次の3つに整理できます。

実名医師レビュー記述(Reviewed by Dr. [Name], MD相当の表記)

機関的・組織的な発信元(医療法人、医療機関、製薬企業、学会、政府機関等)

構造化データによる機械可読性(Schema.orgのArticle、FAQPage、Personエンティティ等)

Jacques et al. (2026)の研究では、医療レビュー記述の存在が、AIに引用されるソースの「Quality Assurance」シグナルとして観察されています。具体的な数値については、ヘルスケアレピュテーション管理企業RepuGenの2026年4月の解説記事が「Reviewed by Dr. [Name], MD」型の記述がAIに引用される健康情報ソースの71.1%に登場したと紹介していますが、この71.1%という具体的数値は本記事執筆時点で原典(arXivプレプリント本文)での直接確認が取れておらず、二次解説に基づく数値である点に留意が必要です。少なくとも、医師レビュー記述の存在がAIに引用されやすい健康情報ソースに広く観察されているという傾向は、研究のフレームワークと一致しており、AIシステムが医師による事前レビューを正確性のシグナルの一つとして扱っている可能性が示唆されます(因果関係の実証ではなく、現時点では「傾向の観察」として理解すべきデータです)。

「医師監修」表記とAI引用の関係を理解する

他方、AI引用の品質には依然として深刻な課題があります。Stanford大学などが2025年にNature Communicationsに発表したSourceCheckup研究(800の質問・58,000のステートメント-ソースペアを分析)では、LLM応答の50〜90%が引用ソースによって完全には支持されておらず、Web検索付きのGPT-4oでさえ約30%の文が引用元によって裏付けられていないことが報告されました。AIは引用したいが、信頼できるソースが足りていない——この需給ギャップこそ、医師監修コンテンツが入り込む余地です。

Q. AIに引用されると、具体的にどんなビジネスインパクトがあるのですか?

A. マーケティングエージェンシーSeer Interactiveが自社で2025年9月に公表した業界調査(2024年6月〜2025年9月、業界横断42組織・3,119のクエリ・25.1Mオーガニックインプレッションを対象)によれば、AI Overviewsに引用されたブランドは、引用されないブランドと比較して35%多い自然検索クリックと91%多い有料検索クリックを獲得していたと報告されています(同社発表によるデータであり、独立した学術検証は本記事執筆時点では未実施です)。同データは医療業界限定ではなく業界横断のものですが、Ahrefsが2025年11月に公表した146Mサイトの分析(2025年9月時点のデータ)では、健康領域はAI Overviews表示率が約43%と全業界中最高水準にあるため、医療コンテンツ事業者にとってAI引用獲得の事業インパクトが大きい領域であることが示唆されます。

日本語サイトでも同じ傾向が当てはまるのか

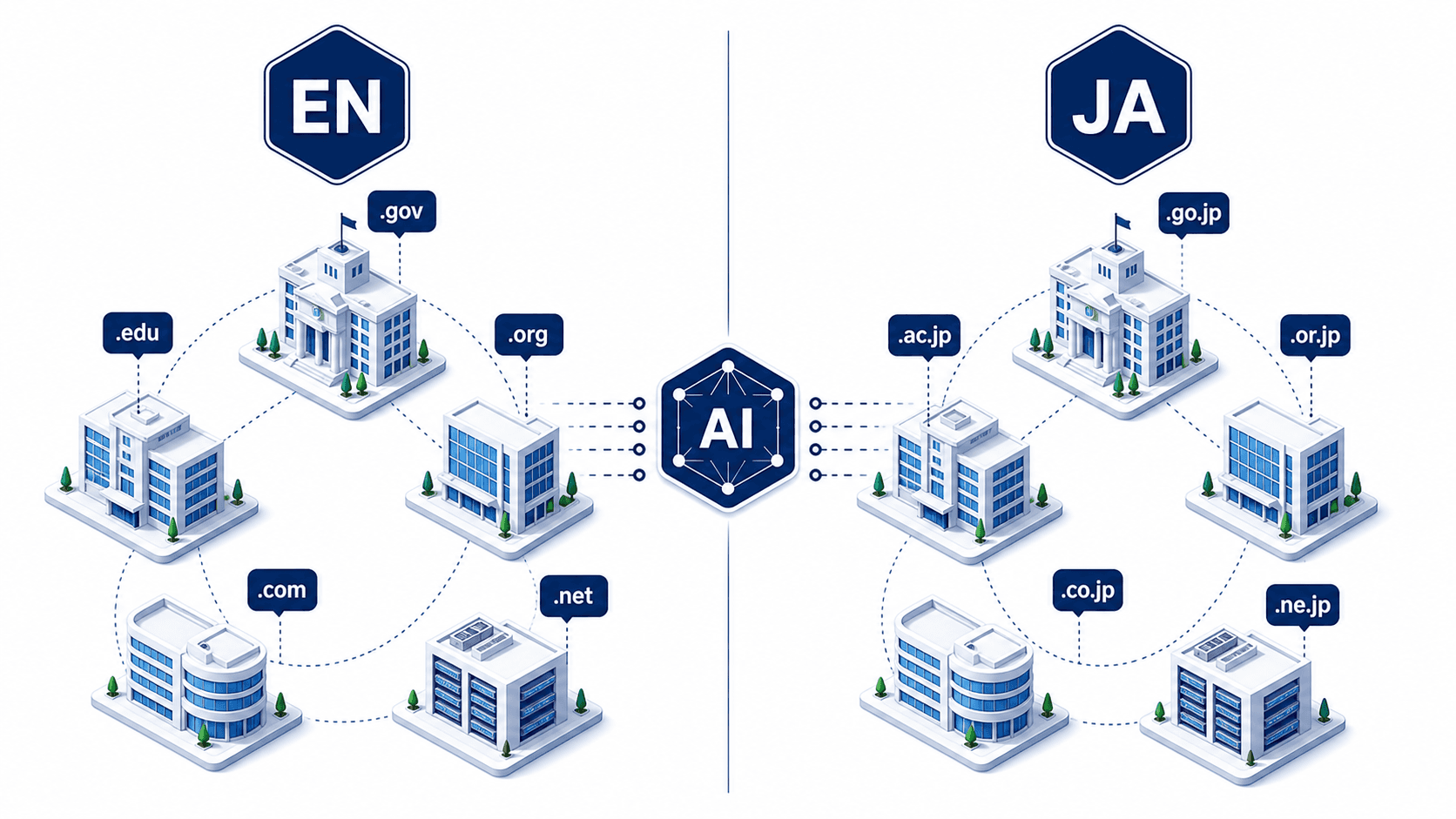

ここまで紹介してきた研究データは、いずれも英語環境のChatGPTやGoogle AI Overviewsを対象にしたものです。実務担当者の方が当然抱く疑問として、「これって日本語のコンテンツでも同じ話なのか?」という問いがあるはずです。本セクションでは、現時点で言えることと、まだ実証されていないことを率直に整理します。

結論先出し:傾向は当てはまると考えられるが、実証研究は不足

結論を先に述べると、AIが権威性シグナルを選別する基本ロジックは言語非依存と考えられるため、日本語環境でも同様の傾向が現れる可能性は高いと推測されます。ただし、日本語コンテンツに特化した体系的な実証研究は本記事執筆時点で確認できていないため、これは「合理的に期待できる方向性」であって「実証された事実」ではない、という点には注意が必要です。

AIエンジンの内部構造そのものは多言語共通で、ChatGPT・Perplexity・GeminiといったLLMは、引用ソースを評価する際に「機関的権威性」「著者の専門性」「品質保証プロセスの存在」「デジタル上の権威指標」といった要素を共通の枠組みで参照しています。Authority Signalsフレームワーク(Jacques et al., 2026)が提示した4ドメイン(Institutional Affiliation / Author Credentials / Quality Assurance / Digital Authority)は、英語環境で抽出された傾向ですが、その評価軸自体は言語依存ではないと考えるのが妥当です。

日本語環境で予測される権威ソース

Mayo ClinicやCleveland Clinic、PubMedといった英語圏の権威ソースは、日本語クエリでは引用されにくくなります。代わりに、日本語環境では以下のような国内のソースが「機関的に確立されたソース」として選別される可能性が高いと推測されます。

カテゴリ | 予測される権威ソース | Authority Signalsの対応ドメイン |

|---|---|---|

公的機関 | 厚生労働省、PMDA(医薬品医療機器総合機構)、国立感染症研究所、消費者庁 | Institutional Affiliation |

診療ガイドライン | Minds(医療情報サービス)、各専門学会の公式ガイドライン | Quality Assurance |

学術データベース | J-Stage、CiNii、PubMed日本語論文 | Author Credentials |

大学病院・機関病院 | 東京大学医学部附属病院、国立がん研究センター、国立循環器病研究センター等 | Institutional Affiliation |

専門学会 | 日本医師会、日本内科学会、日本皮膚科学会等の各専門学会公式サイト | Author Credentials |

商用・専門メディア | メディコレNEWSをはじめとする実名医師監修体制を備えたヘルスケア専門メディア | Quality Assurance |

上記の予測は、Jacques et al. (2026)が英語環境で観察した「機関的に確立されたソース」のカテゴリ分類を、日本の医療情報インフラに置き換えて推定したものです。実際にどのソースがどの程度引用されているかは、各企業が自社ブランド名や関連カテゴリでChatGPT・Perplexity・Geminiにクエリを投げて確認することで、ある程度の傾向を観察できます。

日本語環境特有の論点:薬機法と景表法という追加の制約

もう一つ、日本語コンテンツが英語コンテンツと異なる重要な点があります。それは、薬機法・景品表示法という日本特有の規制環境が存在することです。日本のヘルスケア企業のオウンドメディアは、もともとこれらの規制に対応するために医師監修プロセスを取り入れてきた経緯があります。つまり日本市場では、AI引用獲得を目的とする以前から、医師監修体制を整備する経済合理性が存在していました。

AI時代になって変わるのは、従来「規制対応のための受動的な医師監修」だったものが、「AI引用獲得とブランド評判保全のための能動的な医師監修」へと再定義されるという点です。日本のヘルスケア企業は、本記事で紹介した英語圏の研究知見を活かす素地を、すでに規制環境によって持っているとも言えます。

日本語環境での実証データはこれから作られていく

現時点では、日本語コンテンツに特化したAI引用ソース選別の体系的な実証研究は限定的ですが、これは見方を変えれば「これから日本市場で先行する企業が、独自のデータと知見を蓄積できる空白地帯」でもあります。実際にメディコレ自身も、Medi-ARM(AI Reputation Management)サービスを通じて、日本語環境におけるAI引用パターンの観測データを継続的に蓄積しています。

本記事で紹介した英語圏の知見を出発点として、自社のヘルスケアコンテンツに当てはめながら、日本語環境での挙動を観察・検証していくことが、今後のオウンドメディア戦略の重要な実務テーマになっていくと考えられます。

【技術要件】Schema.orgによる構造化データ実装

AI引用獲得のための技術要件として、いま注目されているのが構造化データ(Schema.org)の実装です。LLMは生のテキストブロックを解析するより、構造化された情報を優先的に抽出する性質があるとされ、Walker Sandsなどの実務分析でも、Schema.orgマークアップは検索エンジンとLLMの双方による正確な意図把握を助けると指摘されています(ただしSchema実装が単独でAI引用を保証するわけではなく、コンテンツの実体的品質を伴う必要があります)。

Generative Engine Optimization(GEO)の代表的な研究であるAggarwal et al. (2024)では、引用文・統計データ・参考文献といった「検証可能なシグナル」を本文に組み込むことで、生成AI上での可視性を有意に向上できることが示されています(原論文では最大40%の可視性向上が報告されています)。構造化データはこの「検証可能性」を機械可読な形で実装する手段として位置付けられます。

ヘルスケアコンテンツで実装すべき4つのSchema

ヘルスケア領域のオウンドメディアで実装すべきSchema.orgのスキーマは、以下の4種類です。実装推奨度の高い順に整理しました(※推奨度は本記事の編集判断に基づくもので、Googleや特定のLLMが公表している優先順位ではありません)。

Schema種別 | 役割 | 主要属性 | 実装推奨度 |

|---|---|---|---|

MedicalWebPage | 医療情報ページとして宣言し監修者を明示 | specialty, lastReviewed, reviewedBy, audience, mainContentOfPage | ★★★ |

FAQPage | Q&A形式の情報を機械可読化 | mainEntity (Question / acceptedAnswer) | ★★★ |

Article | 記事本体の作成情報を明示 | author, datePublished, dateModified, headline | ★★ |

Organization | 発行企業のエンティティ確立 | name, sameAs, contactPoint, logo, publishingPrinciples | ★★ |

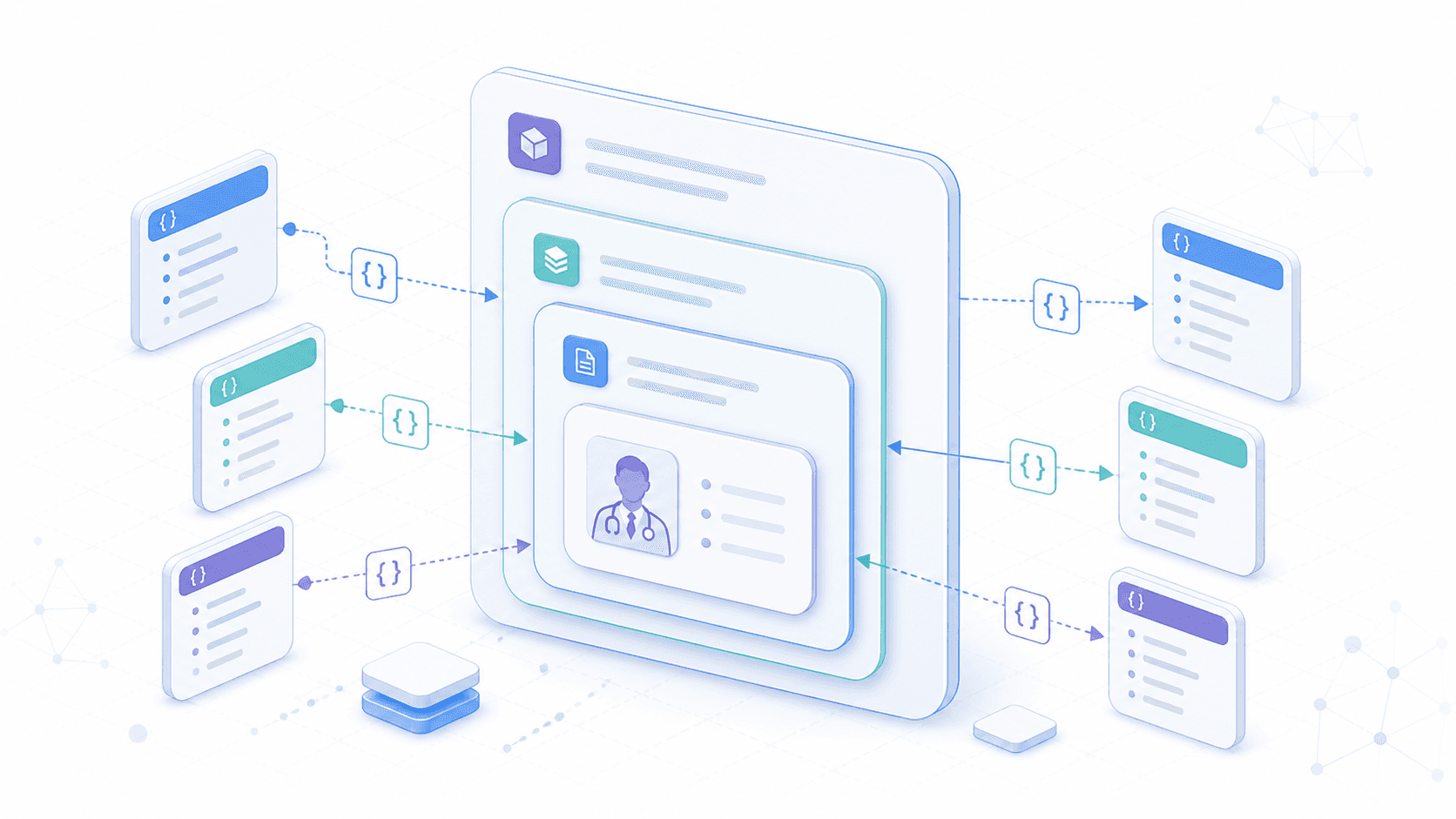

ここで重要なポイントは、医師による監修者を表すreviewedBy属性が、Schema.orgの定義上はWebPage(およびそのサブタイプであるMedicalWebPage)のプロパティとして規定されているという点です。Articleクラス単独では監修者を表す標準プロパティが用意されていないため、医療コンテンツの監修者を機械可読な形でマークアップする場合は、ページ全体をMedicalWebPageとして宣言し、その上でreviewedByを記述する構成が、Schema.org仕様に最も準拠した実装となります。

とくにFAQPage Schemaは、ヘルスケア企業にとって戦略的な意味を持つ実装です。Googleは2023年8月以降、FAQPage Schemaのリッチリザルト表示を「権威ある政府機関・健康関連サイト」に限定する方針を公式に発表しています(Google Search Central公式ドキュメント)。すなわち、ヘルスケア企業のサイトは、この限定された表示対象カテゴリに該当しうる立場にあり、適切な権威性を備えていれば検索結果上のリッチリザルト表示の恩恵を受けられる可能性があります。あわせて、質問と回答のペアを構造化済みの状態で提供できるため、生成AIが回答候補として参照しやすい形式にもなります。

MedicalWebPage SchemaのreviewedBy属性で監修医を明示する

ヘルスケアコンテンツで監修医を機械可読に表すうえで重要な役割を果たすのが、MedicalWebPage Schemaに設定するreviewedBy属性です。authorは記事の執筆者(ライター)、reviewedByは内容を監修した医師、という役割分担で記述します。日本のヘルスケア企業のサイトでは、ページ全体のSchema宣言が単なるWebPageやArticleにとどまっているケース、authorとreviewedByが同一人物として記述されているケース、そしてreviewedBy自体が省略されているケースが目立ちます。MedicalWebPageとして宣言した上で、authorとreviewedByを別個のPersonエンティティとして記述する構成が、AIに対する権威性シグナルとして整理された形になると考えられます。

監修医をPersonエンティティとして記述する際、備えておきたい属性は以下の通りです(Schema.org公式仕様に基づきます)。

name(氏名)

jobTitle(役職)

affiliation(所属医療機関、Organizationエンティティとして)

medicalSpecialty(専門領域、Physicianエンティティで使用)

hasCredential(医師資格・認定医情報をEducationalOccupationalCredentialとして)

sameAs(医師のORCID、医療機関プロフィールページのURL等)

【コンテンツ要件】E-E-A-Tを実装する5つのパターン

GoogleがYMYL(Your Money or Your Life)領域で重視するE-E-A-T——Experience(経験)、Expertise(専門性)、Authoritativeness(権威性)、Trustworthiness(信頼性)——は、生成AIの引用ソース選別ロジックにもそのまま継承されています。

E-E-A-Tの4要素と医療コンテンツでの実装

要素 | 意味 | 医療コンテンツでの実装 |

|---|---|---|

Experience | 実体験・現場経験 | 症例ベースの記述、患者団体との連携、医療現場の具体例の記載 |

Expertise | 専門性 | 監修医の専門分野・経歴・論文実績の明示、医学用語の正確な使用 |

Authoritativeness | 権威性 | 学会ガイドライン・公的機関・査読論文の出典リンク、機関的バックリンク |

Trustworthiness | 信頼性 | 実名・所属の明示、最終監修日の記録、編集方針の公開、誤情報訂正履歴の透明化 |

AI引用を獲得するコンテンツ実装パターン

上記のE-E-A-Tを満たすために、医療コンテンツの記事単位で実装すべきパターンは以下の5点に集約されます。

監修医の実名・所属・専門領域・経歴を記事冒頭または冒頭近くに明示する

執筆日・最終監修日・最終更新日を別個に明記する

医学的事実には公的機関や査読済み論文の出典をリンクで添える

FAQ形式のセクションを記事末尾に5〜8問配置する

結論や要点をリード文と見出し直下に明示的に記述する

とくに5番目の「結論先出し」は、AI抽出効率を大きく左右します。LLMは記事全体を読み込んだうえで要約を生成するわけではなく、関連性の高いパッセージを抽出して組み立てる仕組みになっています。冒頭部分に明確な答えがある記事は、抽出ターゲットとして選ばれやすくなります。

GEO研究が示す引用獲得の3要素

近年のGEO(Generative Engine Optimization)研究では、生成AI上での可視性を有意に向上させる要素として、次の3点セットが指摘されています。

引用文(Quotations)——専門家・公的機関の発言を直接引用する

統計データ(Statistics)——具体的な数値とその出典を本文に組み込む

参考文献(Citations)——記事末尾に参考文献リストを設置する

【運用要件】公開後の継続的なAI引用獲得施策

AI引用獲得は一度の記事公開で完結するものではなく、継続的な運用が必要です。重要な運用要件は3点あります。

運用要件①: 更新頻度とリフレッシュサイクル

AIは情報の新鮮さを評価する傾向があり、最終更新日が古いコンテンツは引用候補から外されやすくなります。マーケティングエージェンシーSeer Interactiveが2025年10月に公表した自社業界調査では、AIボットがアクセスするコンテンツの65%が公開から1年以内、89%が3年以内であったと報告されています(同社発表データ)。医療コンテンツの場合は、学会ガイドライン改訂や薬事承認のタイミングで更新する運用が望まれます。

推奨される更新トリガーは以下の通りです。

学会ガイドラインの改訂(年1回〜数年に1回)

関連する薬機法・景表法の改正(都度)

新薬・医療機器の薬事承認(該当時)

自社商品の仕様変更・新発売(該当時)

最終監修日から1年経過時点での総点検(年次)

運用要件②: llms.txtによる編集方針の宣言

llms.txtは、AIエージェントに対してサイトの公式情報・編集方針・主要コンテンツのインデックスを明示するためのテキストファイルで、業界で提案されている運用慣行の一つです(2026年5月時点でW3Cやその他の標準化団体による正式な仕様にはなっておらず、AIプラットフォーム側の対応状況も一様ではありません)。ただし、ヘルスケア企業の場合、誤った前提でAIに認識されることを防ぐため、自社の編集ポリシーを能動的に宣言しておくことは、低コストで実施できる予防的対応として検討に値します。

ヘルスケア企業のllms.txtに含めることが考えられる項目は次の通りです。

運営企業の正式名称・所在地・連絡先

コンテンツ編集方針(医師監修プロセスの明示)

監修医の実名公開ポリシー

AI生成コンテンツの取り扱い方針

最終監修日の管理ルール

主要記事カテゴリのインデックスURL

運用要件③: AI引用シェアの定期モニタリング

ChatGPT・Perplexity・Geminiといった主要な生成AIに対して、自社ブランド名・主力商品名・関連カテゴリのキーワードを定期的に投げ、回答内に自社サイトが引用ソースとして登場しているかを確認します。海外ではこれを「AI Reputation Management(AI評判管理)」と呼び、独立した業務領域として確立しつつあります。

モニタリングすべき項目は以下です。

自社ブランド名でのAI引用シェア(競合比較含む)

主力商品カテゴリのキーワードでの引用順位

ネガティブ情報のAI上での表示状況

自社監修医の専門領域キーワードでの言及

AIが生成する自社ブランドの説明文の正確性

AI引用獲得チェックリスト10項目

本記事の内容を実務チェックリスト化すると、次の10項目になります。自社のヘルスケアコンテンツが該当するかを確認してみてください。

# | チェック項目 | 領域 |

|---|---|---|

1 | 監修医の実名がページ上に明示されている | コンテンツ |

2 | 監修医の所属・専門領域・経歴がプロフィールとして公開されている | コンテンツ |

3 | 最終監修日が記事内に明記されている | コンテンツ |

4 | MedicalWebPage Schemaが宣言され、reviewedByにPersonエンティティで監修医が記述されている | 技術 |

5 | FAQPage Schemaが実装されており、質問と回答が明確に対応している | 技術 |

6 | Organization Schemaのpublisher属性で運営企業が明示されている | 技術 |

7 | 医学的事実に公的機関・査読論文の出典リンクが付与されている | コンテンツ |

8 | 結論・主要な答えが記事冒頭で簡潔に提示されている | コンテンツ |

9 | llms.txtで自社の編集方針・監修体制が宣言されている | 運用 |

10 | ChatGPT・Perplexityでの自社ブランド引用状況が定期的にモニタリングされている | 運用 |

10項目のうち6つ以上が未対応であれば、AI引用獲得の観点では大きな改善余地があります。とくに1〜4の監修関連項目は、医師監修コンテンツ事業者と連携することで一括して整備できる領域です。

優先順位の決め方:どこから着手すべきか

10項目すべてを同時に対応するのは現実的ではありません。事業インパクトと実装コストの両面から、以下の3段階で優先順位を決めることをおすすめします。

フェーズ | 対応項目 | 想定期間 |

|---|---|---|

Phase 1: 基礎工事 | 項目1〜3、項目8(コンテンツ整備) | 1〜2か月 |

Phase 2: 機械可読化 | 項目4〜6(Schema実装) | 2〜3か月 |

Phase 3: 継続運用 | 項目7、項目9〜10(出典管理・モニタリング) | 3か月以降〜継続 |

よくある質問(FAQ)

Q. 構造化データの実装は社内のエンジニアに依頼すべきですか?それとも外部に委託すべきですか?

A. 実装そのものはJSON-LDの記述ができれば社内エンジニアでも対応可能ですが、医療コンテンツの場合、何をスキーマとして記述するかという設計部分に専門性が必要です。とくに監修医のプロフィール構造化や、医学的事実の出典リンク設計は、医師監修コンテンツ事業者との連携が現実的です。実装はエンジニア、設計は医療コンテンツ専門事業者というハイブリッド体制が、効率的な進め方の一つと考えられます。

Q. 既存の記事をすべて改修するのは現実的ではありません。優先順位はどう決めるべきですか?

A. 3つの基準で優先順位を決めることをおすすめします。第一に検索流入の多い記事、第二に商品購入や問い合わせに直結するBoFu(Bottom of Funnel)記事、第三にブランド名と直接関連する記事です。これらに該当する記事から順に、監修医情報の整備、構造化データの実装、FAQセクションの追加を進めるのが効率的です。

Q. 匿名の医師監修でも、AI引用獲得には十分でしょうか?

A. 十分とは言えません。AIが信頼性シグナルとして読み取れるのは、検証可能な実名情報です。匿名の「医師監修済み」「ドクターチェック済み」といった記載は、人間の読者には一定の安心感を与えますが、AIにとっては検証手段がないため、信頼性シグナルとしての効果が限定的になります。実名・所属・専門領域・経歴の開示を前提とした監修体制への移行が、AI時代の標準仕様となりつつあります。

Q. AI引用を獲得すると、具体的にどんなビジネスインパクトがありますか?

A. マーケティングエージェンシーSeer Interactiveが自社で2025年9月に公表した業界調査(2024年6月〜2025年9月、業界横断42組織・3,119のクエリを対象)では、AI Overviewsに引用されたブランドは、引用されないブランドと比較して35%多い自然検索クリック、91%多い有料検索クリックを獲得していたと報告されています(同社発表によるデータであり、独立した学術検証は本記事執筆時点では未実施です)。同データは医療業界限定ではなく業界横断のものですが、Ahrefsの分析では健康領域がAI Overviews表示率約43%と全業界中最高水準にあり、医療コンテンツ事業者にとってこの傾向の事業インパクトは特に大きいと考えられます。さらに、生成AI経由で来訪するユーザーは事前にAI上で一定の信頼を獲得した状態で訪れるため、コンバージョン率が従来の自然検索より高くなる傾向も観察されています。

Q. AI引用獲得施策の効果は、どれくらいの期間で表れますか?

A. AI引用獲得の効果が表れるまでの期間は、自社サイトの既存の権威性、対象領域の競争状況、AIプラットフォーム側のクロール頻度などによって大きく異なります。GEO実務分野では、構造化データの実装と監修体制の整備から数か月単位でAI引用に影響が観測され始めるケースが報告されていますが、これは保証されたものではありません。ヘルスケア領域はAIが特に慎重に評価するカテゴリーであるため、効果の定着には継続的な運用が必要です。短期的な施策ではなく、中長期のオウンドメディア戦略の中核として位置付けることをおすすめします。

Q. Schemaのauthor属性とreviewedBy属性は、何が違うのですか?

A. authorは記事を執筆した人、reviewedByは記事内容を監修・確認した人を指します。医療コンテンツの場合、ライターが執筆し医師が監修するのが一般的なため、authorにはライターを、reviewedByには監修医を記述するのが正しい使い分けです。なお、reviewedByはSchema.orgの定義上はWebPage(およびそのサブタイプであるMedicalWebPage)のプロパティなので、医療コンテンツではページ全体をMedicalWebPageとして宣言した上でreviewedByを記述する構成が、仕様に準拠した実装となります。両者を同一人物として記述するのは、AIにとっては「監修プロセスがない」状態と同等に解釈されかねないため、分けて記述することをおすすめします。

Q. FAQPage Schemaは、すべての記事に実装すべきですか?

A. すべての記事に実装する必要はありませんが、検索流入の多い記事、購入導線にある記事、ブランド名関連の記事には積極的に実装することをおすすめします。Googleは2023年8月以降、FAQPage Schemaのリッチリザルト表示を「権威ある政府機関・健康関連サイト」に限定する方針を公式に発表していますが、ヘルスケア企業のサイトはこの限定対象に該当しうる立場にあります。なお、実装する際はページ上に表示されているFAQと、Schemaに記述するFAQが完全に一致している必要があります(表示されていないコンテンツのSchema実装はGoogleのガイドラインで禁止されています)。

Q. メディコレに依頼すると、AI引用獲得のために具体的に何をしてもらえますか?

A. メディコレでは、40以上の専門領域にわたる実名公開の専門医ネットワークから、コンテンツ内容に最適な監修者を選定し、AI引用獲得の要件に対応した監修体制を提供しています。具体的には、監修医の実名・所属・専門領域・経歴の整備、構造化データに対応した監修プロフィールの提供、最終監修日・更新日の管理を標準仕様として備えています。また、自社サービスのMedi-ARMでは、ChatGPT・Perplexity・Geminiでの自社ブランドAI引用状況のモニタリングと改善提案までを一貫して支援可能です。

まとめ:AI時代に「医師監修」を再定義する

AIに引用される医療コンテンツの条件は、決して魔法のテクニックではなく、「権威性のシグナルを、AIが読み取れる形で実装する」という一点に集約されます。実名の医師監修、構造化データ、出典の明示、定期的な更新——これらはいずれも、人間の読者にとっても価値のある要素であり、結果として人間とAIの両方から信頼されるコンテンツが生まれます。

本記事で紹介した研究知見はいずれも英語圏で得られたものですが、AIエンジンが権威性シグナルを評価する基本ロジックは言語非依存と考えられるため、日本語コンテンツでも同様の傾向が現れる可能性は高いと推測されます。日本市場では、薬機法・景表法という規制環境のもとですでに医師監修プロセスが組み込まれているケースが多く、AI時代の要件を満たす素地を最初から備えているとも言えます。その素地を、規制対応のための受動的なものから、AI引用獲得とブランド評判保全のための能動的なものへと再定義する——それが、いま日本のヘルスケア企業に求められる発想転換です。

従来のSEOでは、検索アルゴリズムへの最適化と読者への誠実さがしばしば対立する場面がありました。AI時代のヘルスケアコンテンツでは、この対立は解消されます。AIに引用されるコンテンツは、人間にとっても良いコンテンツである——この原則を出発点に、自社のオウンドメディアやコーポレートサイトを点検することから始めてみてください。