🗒️ この記事でわかること |

|---|

|

2026年に入ってから、医療・ヘルスケアコンテンツをめぐる世界の景色が大きく変わりつつあります。1月にはThe Guardianの調査報道を受けて、Googleが一部の健康関連クエリでAI Overviewsの応答を削除する措置を取りました。さかのぼって2023年11月には、米国の老舗メディアSports Illustratedが架空のAI生成著者プロフィール下で記事を公開していた事案がFuturismの報道により発覚し、当該記事を削除する対応に追い込まれました。同じ頃、米国民の医療AIへの開放性は低下傾向にあり、日本では政府主導でヘルスケアAIの安全性評価ガイドが策定されました。

これらの動向に共通するのは、ひとつのキーワードです。「人間の医師による検証」。AIが医療情報の生産・流通の主役に躍り出ようとしたまさにその瞬間、市場と規制が同時に「医師の関与」を信頼性確保の重要な品質担保の手段として再評価し始めました。本コラムでは、海外の最新事例と研究データを手がかりに、いま医師監修コンテンツが再評価されている背景と、企業のマーケティング部門にとってこの変化が何を意味するのかを整理します。

AIは「医師監修」を信頼の通貨として学習している

2026年1月にmedRxivで査読前プレプリントとして公開された米国の研究「Authority Signals in AI Cited Health Sources」(Jacques et al., 2026)は、ChatGPT 5.2 Proに100の消費者向け健康質問を入力し、回答に引用された615ソースを分析しました。この研究の重要な観察結果は、引用されたソースの構造に明確な傾向が見られたことです。論文によれば、引用ソースの75%以上がMayo Clinic、Cleveland Clinic、NHS、PubMedといった機関的に確立された情報源から来ていたと報告されています。AIは健康情報を生成する際、無作為に情報を集めているのではなく、明確な「権威性シグナル」を選別している可能性が示唆されています。

そのシグナルのひとつが、米国のヘルスケア業界で注目されている「Reviewed by Dr. [Name], MD」という医療レビュー記述です。米国のレピュテーション管理企業RepuGenが2026年4月に公開した二次解説記事によれば、こうした医師レビュー記述はAI健康ツールに引用されるソースの71.1%に登場しているとされています(なお、この71.1%という数値は、Authority Signals研究のQuality Assurance Domainに関する記述であり、原典論文の本文での直接確認は本記事執筆時点で取れていないため、二次解説に基づく記述として扱います)。日本でいう「医師監修」表記は、海外でも同様にAI引用獲得において重要なシグナルになりうる可能性が示唆されています。

この観察結果は、自社サイトの記事に医師監修を入れるかどうかを「コストの問題」として議論してきた企業にとって、再考の機会を意味します。検索流入の獲得競争はすでに次のフェーズ、つまりAIエンジンに引用されるかどうかの競争へと拡張されつつあります。

「AIスロップ」氾濫と、人間レビューへの揺り戻し

AI生成コンテンツの「量産可能性」を試したメディアが信頼性の問題に直面した事例が、ここ数年に集中しています。象徴的なのが、米国の老舗スポーツ誌Sports Illustratedの2023年11月の事案です。テック系メディアFuturismの調査報道(2023年11月27日)によれば、Sports Illustratedは第三者ベンダー経由でAI生成記事を架空の著者プロフィール下で公開していたことが発覚し、報道後に該当記事を削除する対応に追い込まれました。NPRなどの後続報道によれば、テック系媒体CNETも2023年初頭にAI生成記事の半数以上に訂正を発行する事態に至っています。

対照的な動きが、ヘルスケアコンテンツ業界で進んでいます。米国のヘルスケアコンテンツ大手・WebMDの企業向け部門であるWebMD Igniteは2026年、自社の公式ブログ記事「AI in healthcare: Structured content is healthcare's answer to AI disruption」において、AI生成コンテンツの氾濫を「AIスロップ(AI slop=粗悪なAIコンテンツ)」と呼び、自社の「臨床的にレビューされたコンテンツ」をAI時代の差別化ポイントとして位置付けました。同社は「AIは人間のコンテンツ制作者を支援するツールであり、置き換えるものではない」という方針を明確に表明しています。

米国オンライン健康メディアの代表格・Healthlineも、公式ページ(About Us、Content Integrity、Editorial Process)で、執筆時点で「すべての健康情報は人間が人間のために作成しており、生成AIツールで作成されたコンテンツは公開しない(All our health information is created by humans for humans, and we do not publish content developed using generative AI tools.)」と明確に表明しています。WebMD IgniteとHealthlineという、米国を代表する2社のヘルスケアメディアがそろって「人間レビューの価値」を中核に据えた発信を行っていることは、医療コンテンツ業界における方向性を示す重要なシグナルといえます。

一般メディアでのAI量産戦略の頓挫と、医療メディアでの人間レビュー徹底戦略の強化——この対比は、コンテンツマーケティングの優先順位の変化を示しています。とくに医療・健康・美容といったYMYL(Your Money or Your Life)領域では、「人間の医療専門家による検証」が単なる差別化要素ではなく、ブランドが市場で生き残るための前提条件になりつつあります。日本市場でも、薬機法・医療広告ガイドライン・景品表示法の遵守を前提としたうえで、医師監修を「形式的な表記」ではなく「実質的な品質担保プロセス」として運用することが、AI時代の競争優位の基礎になっていくと考えられます。

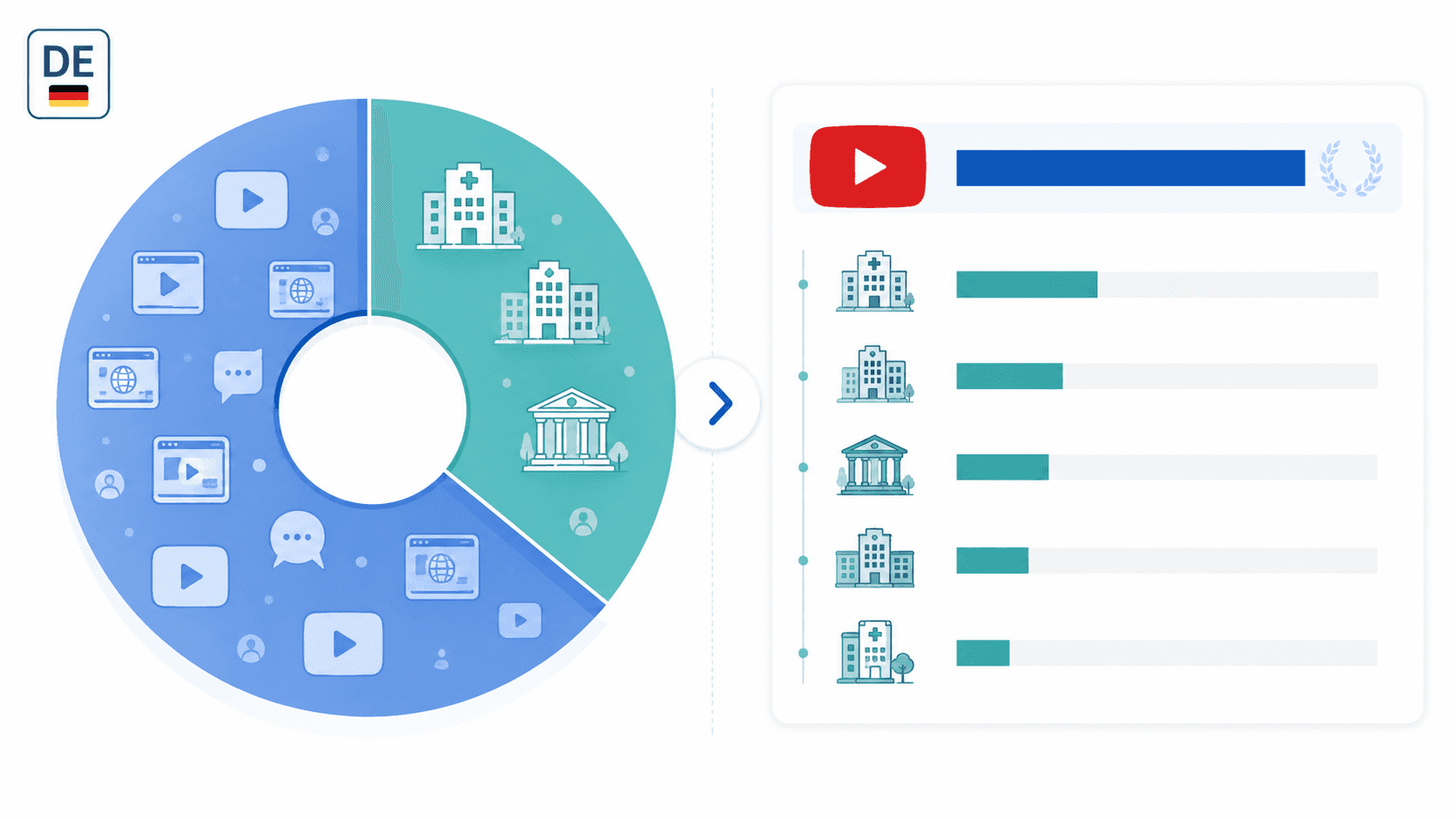

Google AI Overviewsをめぐる調査報道と引用ソース選別

2026年1月、英国のThe Guardianによる調査報道を受けて、Googleは特定の健康関連クエリでAI Overviewsの応答を削除する措置を取りました。報道では、AI Overviewsの一部応答に医療現場の標準的な指導と異なる内容が含まれていた事例が指摘されました。具体的には、肝機能検査の参照範囲を年齢・性別・民族・国籍を考慮せずに表示していた事例、膵臓がん患者に対して「高脂肪食を避けるように」という、医療専門家の推奨と異なるガイダンスを表示していた事例などが報告されています。

この背景には、AI Overviewsの引用ソース選別における構造的特性が指摘されています。マーケティングプラットフォームSE Ranking社が2026年1月に公表した分析(50,000以上の健康関連クエリから抽出された465,823件の引用ソースをドイツ語のAI Overviewsで分析)によれば、AI Overviewsが引用したソースのうち、SE Ranking社が「より信頼できる医療情報源」(病院・クリニック・医療学会・公的医療機関など)に分類したのは34.45%にとどまり、残り65.55%は医学的正確性やエビデンスベースの基準に従って設計されていないソースから引用されていたとされています。なお、これは引用ソースの分類比率であって、引用された情報の正確性を直接測定したものではありません。また、本データはドイツ語環境のものであり、英語圏や日本語圏で同じ傾向がそのまま当てはまるかは別途検証が必要です。

Stanford大学を中心とする研究チームが2025年にNature Communicationsに発表したSourceCheckup研究(Wu et al., 2025、800の健康関連質問・約58,000のステートメント-ソースペアを分析)では、LLM応答の50〜90%が引用ソースによって完全には支持されておらず、Web検索付きのGPT-4oでさえ約30%の文が引用元によって裏付けられていないことが報告されました。AIの「もっともらしい応答」と「医学的に正しい応答」の間にギャップが構造的に存在することを示す研究知見です。

米国の医療AI受容性低下、そして日本のガイドライン整備

Ohio State University Wexner Medical Centerが2026年4月7日に公表した米国の世論調査(全米成人n=1,007、SSRS Opinion Panel Omnibusによる調査、2026年1月16〜20日実施、誤差±3.5パーセントポイント)は、業界に静かな注目を集めました。AIを医療に取り入れることに開放的な米国人は、2024年の52%から2026年には42%へと10ポイント低下。AIが医療を効率化できると信じる人も64%から55%へと低下していました。米国のAI診断研究はむしろ前進している時期にもかかわらず、消費者側の受容性は逆方向に動いている——この乖離が、医療コンテンツビジネスにおける「人間による検証」の市場価値を押し上げている可能性があります。

同時に注目すべきは、米国民が依然としてAIを「自分用の補助ツール」としては使い続けていることです。同調査では62%が症状理解にAIを使用、44%が検査結果や診断の説明にAIを使用していると報告されています。つまり「AIで一次情報を取り、最終判断は医師に確認する」という二層構造の情報行動が広がりつつあります。企業の医療コンテンツも、AIに引用されるための一次情報層と、医師監修によって最終確認される信頼層の両方を備える必要が出てきています。

国内に目を移すと、2026年4月3日、JaDHA(日本デジタルヘルス・アライアンス)がAIセーフティ・インスティテュート(AISI、独立行政法人情報処理推進機構IPAが運営)と連携し、「ヘルスケア領域におけるAIセーフティ評価観点ガイド」を策定しました。背景には、2025年12月23日に閣議決定された「人工知能基本計画」において、医療・ヘルスケア分野が人手不足が顕著な分野として支援対象に明記されたことがあります。同ガイドはハルシネーションによる健康被害リスク、プライバシー保護、セキュリティ確保といったヘルスケア領域特有の課題への対応を企業に求めるもので、事業者には「開発・設計段階からの安全性担保」が要求されるようになりました。

米国アメリカ医師会(AMA)のAMA Center for Digital Health and AIが2026年3月12日に発表した「2026 Physician Survey on Augmented Intelligence」(医師n=1,692、2026年1月15日〜2月2日調査)も同じ方向を指しています。AIの認知または利用を報告する医師は2026年に81%に達し、2023年の38%から2倍以上に増加しました。技術の物珍しさから実装フェーズへ、そして同時に、誰がその情報を保証するかが重視される段階に入りつつあります。

日本企業が今すぐ取るべき3つのアクション

ここまでの海外動向を踏まえて、日本企業のマーケティング部門が直視すべき変化を3点に整理します。

アクション①: コーポレートサイトとオウンドメディアのE-E-A-T監査

健康・美容・サプリメント・OTC・医療機器・ヘルスケアアプリといったYMYL(Your Money or Your Life)領域に該当するコンテンツについて、現状どこまで医師監修が入っているか、監修者の氏名・所属・専門領域がきちんと表示されているか、監修日が明記されているかを棚卸しする必要があります。AI引用において「Reviewed by Dr.〇〇」相当の記述があるかどうかは、もはや装飾ではなく機能要件として位置付けが変わりつつあります。

アクション②: AI引用獲得を前提としたコンテンツ設計

従来のSEOは検索ランキング上位を取ることを目標にしていましたが、AI Overviews・ChatGPT・Perplexity・Geminiといった生成AI検索が前提になると、評価対象は「人間が読みやすいか」だけでなく「AIが構造化情報として抽出しやすいか」になります。FAQ形式での記述、明示的な医学的出典、監修医プロフィールの構造化データ、定期的な更新日の明示——こうした要素を体系的に整えていく必要があります。本コラムの姉妹記事『AIに引用される医療コンテンツの条件』では、より詳細なチェックリスト10項目を整理しています。

アクション③: ブランド名のAI上での見え方の継続的モニタリング

ChatGPTやPerplexityで自社ブランド名や主力商品名を検索したとき、どのソースがどんな文脈で引用されているのか、ネガティブな情報がデフォルトで表示されていないかを定期的にチェックする運用が、すでに海外では「AI Reputation Management(AI評判管理)」という独立した分野として確立しつつあります。広報部門と連携した監視体制の構築が、ブランド毀損リスクの早期発見につながります。

薬機法・景品表示法・医師法の規制が厳しい日本市場では、もともと「医師監修」が広告制作・LP制作・EC商品ページの実務に深く根づいてきました。しかし、その目的の多くは「規制対応のための保険」という消極的なものでした。AI時代の医師監修は、これとは性格が異なります。AI引用を勝ち取り、ブランド評判を守り、消費者の最終判断を後押しする——攻めの装置へと再定義する時期に来ています。

よくある質問(FAQ)

Q. AI Overviewsが医療領域から完全に撤退したということですか?

A. いいえ、すべての健康関連検索からAI Overviewsが消えたわけではありません。2026年1月にThe Guardianによる調査報道を受けてGoogleが応答を削除したのは、特定の健康関連クエリ群とされており、Googleは引き続き健康関連でのAI Overviews運用を続けています。Googleの公式コメントでは「AI Overviewsの大半は事実に基づいており、有用である」とされており、機能本体の継続運用と、個別クエリへの限定的対応が併存している状況です。

Q. 「医師監修」の表記さえあれば、AIに引用されやすくなるのでしょうか?

A. 表記だけでは不十分と考えられます。海外の研究で評価が高いのは、監修医の氏名・所属・専門分野・経歴が明示され、監修日が記録され、可能であれば構造化データ(Schema.org)でも宣言されているコンテンツです。匿名の「医師監修済み」という表記のみでは、AIが信頼性シグナルとして読み取れない場合があります。実名・プロフィール開示・更新日明示の3点セットで運用することをおすすめします。

Q. 自社サイトのコンテンツが、ChatGPTやPerplexityに引用されているかを調べる方法はありますか?

A. 一次的には、ChatGPT・Perplexity・Geminiといった主要な生成AI検索で、自社ブランド名・主力商品名・関連カテゴリのキーワードを検索し、回答内に自社サイトが引用ソースとして表示されるかを目視で確認する方法が現実的です。継続的なモニタリングを行うのであれば、AI上の引用シェアやセンチメントを定量的に追跡する専用ツール、あるいは外部のAI Reputation Managementサービスを活用する企業が国内でも増えてきています。

Q. Sports Illustratedのように、AI生成コンテンツを使うこと自体がリスクなのでしょうか?

A. AI生成コンテンツの活用そのものが問題というより、医療・健康領域においては人間の医療専門家による事前レビューを欠いた状態で公開すること、および第三者ベンダーへの依存と検証プロセスの不透明さがリスクとなりうる、という整理が現時点では妥当と考えられます。実際、Sports Illustratedの2023年事案では、第三者ベンダー(AdVon Commerce)への業務委託において、架空の著者プロフィールやAI生成記事の混入を編集チームが把握できていなかったことが問題の中核でした。一方、Healthlineは公式ページで「生成AIツールで作成されたコンテンツは公開しない」と明言し、WebMD Igniteも「AIは人間のコンテンツ制作者を支援するツールであり、置き換えるものではない」という方針を表明しています。AIで下書きを高速化し、医師監修・薬機法景表法レビュー・広告審査の多層フローで品質を担保するという両立アプローチが、現時点での標準的な運用と考えられます。なお、医師監修は重要な品質担保の手段ではありますが、それ自体で薬機法上の効能効果標榜の制限や景品表示法上の表現制限が解除されるわけではない点には留意が必要です。

Q. 国内のJaDHAガイドラインは、事業会社にも関係しますか?

A. はい、関係する可能性があります。JaDHA・AISIが2026年4月3日に策定した「ヘルスケア領域におけるAIセーフティ評価観点ガイド」は、医療AIプロダクトの開発企業だけでなく、ヘルスケア領域でAIを活用するすべての事業者を視野に入れて策定されています。健康関連コンテンツをAIで生成・配信する企業や、AIを活用した健康相談機能を持つアプリ・サービス事業者も、安全性評価の枠組みを参照することが推奨されると考えられます。今後、業界の自主ガイドラインや行政指導の前提となる可能性が高い文書ですので、早めの内容確認をおすすめします。

Q. メディコレに監修を依頼するメリットは何ですか?

A. メディコレは40以上の専門領域にわたる実名公開の専門医ネットワークを擁し、本コラムで紹介したAI時代の要件——実名・所属・専門分野・経歴の明示、監修日の記録、構造化データへの対応——を標準仕様として満たす監修体制を提供しています。詳細はお問い合わせください。

Q. Authority Signals研究の数値はどこまで信頼できますか?

A. Authority Signals研究(Jacques et al., 2026)はmedRxivに公開された査読前のプレプリントであり、最終的な査読・出版時に数値や結論が修正される可能性があります。本記事で引用している「75%以上が機関的に確立されたソース」という観察結果は、ChatGPT 5.2 Proに100の質問を入力して得た615ソースの分析という、特定条件下での結果です。また、Quality Assurance Domainの71.1%という数値については、原典論文の本文での直接確認が本記事執筆時点で取れておらず、RepuGen社による二次解説に基づく記述です。これらの研究結果を企業戦略に活用する際は、データの適用範囲・測定条件を踏まえた上で参考にすることをおすすめします。

まとめ:AI時代だからこそ、医師監修の社会的価値が高まっている

2026年に入ってからの世界の動向を総合すると、医療コンテンツの世界では「AIによる量産」と「人間による検証」の間で、明確な役割分担が始まりつつあります。AIはコンテンツ制作と一次情報提供を高速化する一方、最終的な信頼性は人間の医師による監修に依拠する——この二層構造が標準になりつつあります。

Sports IllustratedやCNETに代表されるAI量産戦略の頓挫、Google AI Overviewsをめぐる調査報道、WebMD IgniteとHealthlineが公式に表明する人間レビュー方針、米国民の医療AI受容性低下、日本のJaDHAガイドライン策定。これら一見バラバラに見える動向は、すべて同じ方向を指しています。すなわち、AI時代だからこそ、医師監修の社会的価値はかつてなく高まっているということです。

規制対応のための受動的な医師監修から、AI引用獲得とブランド評判保全のための能動的な医師監修へ——この転換は、ヘルスケア領域でビジネスを展開するすべての企業にとって、避けて通れないテーマになっていくと考えられます。

ただし、最後に重要な留意点を一つ挙げておきます。医師監修は、コンテンツの医学的正確性とAI引用獲得という観点で重要な品質担保の手段ではありますが、それ自体が薬機法・医療広告ガイドライン・景品表示法上の安全性を完結的に担保するものではありません。たとえば医薬品的な効能効果の標榜、断定的・保証的表現、誇大広告に該当しうる表現は、医師監修があっても法令違反となりえます。AI時代に企業が目指すべきは、医師監修と薬機法・景表法レビュー、そして広告審査体制を組み合わせた多層的な品質保証フローの構築です。本記事で論じた「医師監

修の戦略的価値」は、この多層フローの一要素として理解いただくのが適切です。

メディコレWEBによる医師監修

オンライン完結で医師監修ができるメディコレWEBについては以下の記事をご確認ださい。

▶︎「オンライン完結!メディコレの医師監修サービス「メディコレWEB」とは?」

また、メディコレWEBの医師監修で実際に何がチェックされるのか、専門医が出した7件の修正指示を実例公開した記事もあわせてご覧ください。

▶︎メディコレWEBの医師監修プロセスを実例公開|専門医が22分間で出した7件の修正指示

ご興味いただけましたら、いつでもお気軽にお問い合わせください。